英伟达推出 VideoLDM,根据文本可生成 4.7 秒视频

来源:搜狐号-IT之家 时间:2023-04-20 16:06:29

(相关资料图)

(相关资料图)

IT之家 4 月 20 日消息,英伟达和康奈尔大学的研究团队合作,近日推出了名为 VideoLDM 模型,可以根据文本描述,自动生成最高分辨率 2048*1280、24 帧、最长 4.7 秒的视频。

英伟达表示该模型配有 41 亿个参数,其中 27 亿个经过视频训练,这符合现代生成式 AI 的标准。IT之家从博文中获悉,英伟达表示通过高效的潜在扩散模型(LDM),能够创建多样化、高质量、高清晰度的视频。

该模型还能创建驾驶场景的视频,视频分辨率为 1024 × 512 像素,最长 5 分钟。英伟达表示目前该项目处于研究阶段,暂时不会向公众开放。

详细报告可以访问:https://research.nvidia.com/labs/toronto-ai/VideoLDM/

标签:

-

英伟达推出 VideoLDM,根据文本可生成 4.7 秒视频

IT之家4月20日消息,英伟达和康奈尔大学的研究团队合作,近日推出了名为VideoLDM模型,可以根据文本描述,自动生成最高分辨率2048*128

英伟达推出 VideoLDM,根据文本可生成 4.7 秒视频

IT之家4月20日消息,英伟达和康奈尔大学的研究团队合作,近日推出了名为VideoLDM模型,可以根据文本描述,自动生成最高分辨率2048*128 -

TechInsights:2023 年全球翻新手机销量将同比下降 8%

IT之家4月20日消息,TechInsights研究数据显示,2023年全球翻新手机销量将同比下降8%,随后在2024年恢复增长。在全球大多数

TechInsights:2023 年全球翻新手机销量将同比下降 8%

IT之家4月20日消息,TechInsights研究数据显示,2023年全球翻新手机销量将同比下降8%,随后在2024年恢复增长。在全球大多数 -

天天热门:SE《最终幻想1~6》像素复刻版合集上线 PS4、任天堂 Switch 平台

IT之家4月20日消息,为庆贺《最终幻想》系列诞生35周年,SE《最终幻想1-6像素复刻版》今日正式上线任天堂Switch以及索尼PS4

天天热门:SE《最终幻想1~6》像素复刻版合集上线 PS4、任天堂 Switch 平台

IT之家4月20日消息,为庆贺《最终幻想》系列诞生35周年,SE《最终幻想1-6像素复刻版》今日正式上线任天堂Switch以及索尼PS4 -

即时:AMD R9 7940HS 核显最新测试流出:跑分提升15%

IT之家4月20日消息,海外评测者“ETAPRIME”今日放出了R97940HS核显Radeon780M的测试数据。据介绍,测试的笔记本为

即时:AMD R9 7940HS 核显最新测试流出:跑分提升15%

IT之家4月20日消息,海外评测者“ETAPRIME”今日放出了R97940HS核显Radeon780M的测试数据。据介绍,测试的笔记本为 -

全球实时:工信部:我国建成 5G 基站超 264 万个,全国建成千兆城市 110 个

IT之家4月20日消息,国新办今日就2023年一季度工业和信息化发展情况举行发布会。会上,工业和信息化部总工程师、新闻发言人赵志国介绍了最新的

全球实时:工信部:我国建成 5G 基站超 264 万个,全国建成千兆城市 110 个

IT之家4月20日消息,国新办今日就2023年一季度工业和信息化发展情况举行发布会。会上,工业和信息化部总工程师、新闻发言人赵志国介绍了最新的 -

播报:Ubuntu 发行版更新 Linux 内核,修复 17 个安全漏洞

IT之家4月20日消息,Canonical于今天面向所有处于支持状态的Ubuntu发行版,发布了Linux内核安全更新,累计修复了17个安

播报:Ubuntu 发行版更新 Linux 内核,修复 17 个安全漏洞

IT之家4月20日消息,Canonical于今天面向所有处于支持状态的Ubuntu发行版,发布了Linux内核安全更新,累计修复了17个安

-

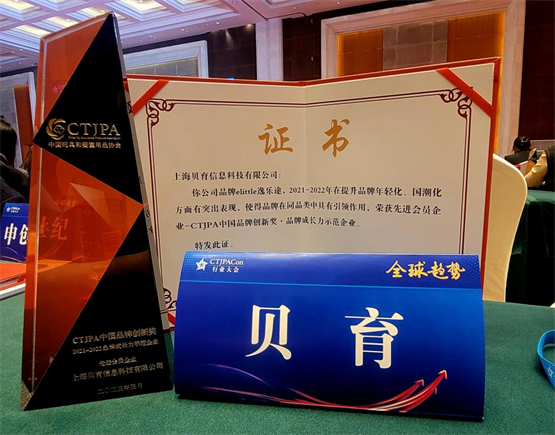

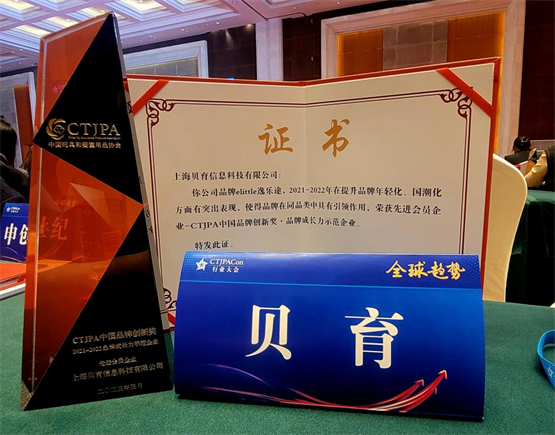

守正创新 逸乐途斩获CTJPA中国品牌创新奖 近日,由中国玩具和婴童用品协会(以下简称中玩协)主办,以不确定时代,企业如何重塑增长为主题的玩具和婴童用品创新发展高峰论坛在苏州太

守正创新 逸乐途斩获CTJPA中国品牌创新奖 近日,由中国玩具和婴童用品协会(以下简称中玩协)主办,以不确定时代,企业如何重塑增长为主题的玩具和婴童用品创新发展高峰论坛在苏州太 -

天天热门:SE《最终幻想1~6》像素复刻版合集上线 PS4、任天堂 Switch 平台

IT之家4月20日消息,为庆贺《最终幻想》系列诞生35周年,SE《最终幻想1-6像素复刻版》今日正式上线任天堂Switch以及索尼PS4

天天热门:SE《最终幻想1~6》像素复刻版合集上线 PS4、任天堂 Switch 平台

IT之家4月20日消息,为庆贺《最终幻想》系列诞生35周年,SE《最终幻想1-6像素复刻版》今日正式上线任天堂Switch以及索尼PS4 -

当前简讯:马斯克:特斯拉今年推出全自动驾驶 汽车价值将大幅提升 马斯克:特斯拉今年推出全自动驾驶汽车价值将大幅提升

当前简讯:马斯克:特斯拉今年推出全自动驾驶 汽车价值将大幅提升 马斯克:特斯拉今年推出全自动驾驶汽车价值将大幅提升 -

英伟达推出 VideoLDM,根据文本可生成 4.7 秒视频

IT之家4月20日消息,英伟达和康奈尔大学的研究团队合作,近日推出了名为VideoLDM模型,可以根据文本描述,自动生成最高分辨率2048*128

英伟达推出 VideoLDM,根据文本可生成 4.7 秒视频

IT之家4月20日消息,英伟达和康奈尔大学的研究团队合作,近日推出了名为VideoLDM模型,可以根据文本描述,自动生成最高分辨率2048*128 -

全球实时:工信部:我国建成 5G 基站超 264 万个,全国建成千兆城市 110 个

IT之家4月20日消息,国新办今日就2023年一季度工业和信息化发展情况举行发布会。会上,工业和信息化部总工程师、新闻发言人赵志国介绍了最新的

全球实时:工信部:我国建成 5G 基站超 264 万个,全国建成千兆城市 110 个

IT之家4月20日消息,国新办今日就2023年一季度工业和信息化发展情况举行发布会。会上,工业和信息化部总工程师、新闻发言人赵志国介绍了最新的 -

世界热推荐:“一夜回冬”!山西发布“霜冻+寒潮”双预警 山西省气象台2023年4月20日15时35分发布霜冻蓝色预警,预警区域:太原北部、大同、朔州、忻州、吕梁、晋中、阳泉、临汾北部、长治北部。预计未

世界热推荐:“一夜回冬”!山西发布“霜冻+寒潮”双预警 山西省气象台2023年4月20日15时35分发布霜冻蓝色预警,预警区域:太原北部、大同、朔州、忻州、吕梁、晋中、阳泉、临汾北部、长治北部。预计未 -

热资讯!河北保定公布2023年第一批“揭榜挂帅”技术需求榜单 央广网保定4月20日消息(见习记者王艺霖通讯员陈茜)砥砺创新,共谋发展。4月19日,河北省保定市公布2023年第一批“揭榜挂帅”技术需求...

热资讯!河北保定公布2023年第一批“揭榜挂帅”技术需求榜单 央广网保定4月20日消息(见习记者王艺霖通讯员陈茜)砥砺创新,共谋发展。4月19日,河北省保定市公布2023年第一批“揭榜挂帅”技术需求... -

TechInsights:2023 年全球翻新手机销量将同比下降 8%

IT之家4月20日消息,TechInsights研究数据显示,2023年全球翻新手机销量将同比下降8%,随后在2024年恢复增长。在全球大多数

TechInsights:2023 年全球翻新手机销量将同比下降 8%

IT之家4月20日消息,TechInsights研究数据显示,2023年全球翻新手机销量将同比下降8%,随后在2024年恢复增长。在全球大多数 -

即时:AMD R9 7940HS 核显最新测试流出:跑分提升15%

IT之家4月20日消息,海外评测者“ETAPRIME”今日放出了R97940HS核显Radeon780M的测试数据。据介绍,测试的笔记本为

即时:AMD R9 7940HS 核显最新测试流出:跑分提升15%

IT之家4月20日消息,海外评测者“ETAPRIME”今日放出了R97940HS核显Radeon780M的测试数据。据介绍,测试的笔记本为 -

快手签约主播怎么抽成?如何直播? 在快手,大家如果是这个平台的签约,主播或者是签约创作者带点是不可以去别的平台再去发布自己的视频的签约,主播也有相关的抽成,快...

快手签约主播怎么抽成?如何直播? 在快手,大家如果是这个平台的签约,主播或者是签约创作者带点是不可以去别的平台再去发布自己的视频的签约,主播也有相关的抽成,快... -

全球百事通!宝马MINI的冰淇淋只配老外吃:高管刚表示BMW家在中国 宝马MINI的冰淇淋只配老外吃:高管刚表示BMW家在中国

全球百事通!宝马MINI的冰淇淋只配老外吃:高管刚表示BMW家在中国 宝马MINI的冰淇淋只配老外吃:高管刚表示BMW家在中国 -

天天动态:快手扣税20%还给退回来吗?快币如何充值? 在快手开店的时候,如果达到了纳税的标准,一样的各位商家也是需要按时的去缴纳税款的,快手这个平台,上面扣税的比例也是有规定的,...

天天动态:快手扣税20%还给退回来吗?快币如何充值? 在快手开店的时候,如果达到了纳税的标准,一样的各位商家也是需要按时的去缴纳税款的,快手这个平台,上面扣税的比例也是有规定的,... -

劳斯莱斯女车主被销售看不起 不让进展台 转身定了辆仰望U8 劳斯莱斯女车主被销售看不起不让进展台转身定了辆仰望U8

劳斯莱斯女车主被销售看不起 不让进展台 转身定了辆仰望U8 劳斯莱斯女车主被销售看不起不让进展台转身定了辆仰望U8 -

环球信息:一季度经济复苏超预期,A股牛市来不来? 央广网4月20日北京消息(记者孙汝祥)近日公布的中国经济一季报亮点纷呈,4 5%的GDP增速超出市场预期,相关数据确认中国经济正在强势复苏中。

环球信息:一季度经济复苏超预期,A股牛市来不来? 央广网4月20日北京消息(记者孙汝祥)近日公布的中国经济一季报亮点纷呈,4 5%的GDP增速超出市场预期,相关数据确认中国经济正在强势复苏中。 -

斯柯达研发新EA211系列发动机:全新帕萨特、速派等50车搭载 斯柯达研发新EA211系列发动机:全新帕萨特、速派等50车搭载

斯柯达研发新EA211系列发动机:全新帕萨特、速派等50车搭载 斯柯达研发新EA211系列发动机:全新帕萨特、速派等50车搭载 -

快手好运来是什么活动?怎么容易中奖? 目前在快手直播间经常有一些抽奖活动可以参与,比如说快手好运来活动。那么快手好运来是什么活动?如何容易中奖?下面给大家说一下。

快手好运来是什么活动?怎么容易中奖? 目前在快手直播间经常有一些抽奖活动可以参与,比如说快手好运来活动。那么快手好运来是什么活动?如何容易中奖?下面给大家说一下。 -

当前短讯!一季度北京GDP同比增长3.1% 经济整体回升向好 4月20日,北京市召开2023年一季度北京经济运行情况新闻发布会。记者从会上获悉,根据地区生产总值统一核算结果,全市实现地区生产总值9947 7亿

当前短讯!一季度北京GDP同比增长3.1% 经济整体回升向好 4月20日,北京市召开2023年一季度北京经济运行情况新闻发布会。记者从会上获悉,根据地区生产总值统一核算结果,全市实现地区生产总值9947 7亿 -

远古发现丨终于看清细节!古生物学家为5.2亿年前的虫子拍CT 新华社昆明4月19日电(记者岳冉冉)运用先进技术手段,古生物学家揭开了澄江生物群中的等刺虫化石的形态秘密。该成果于北京时间4月19日在线发

远古发现丨终于看清细节!古生物学家为5.2亿年前的虫子拍CT 新华社昆明4月19日电(记者岳冉冉)运用先进技术手段,古生物学家揭开了澄江生物群中的等刺虫化石的形态秘密。该成果于北京时间4月19日在线发 -

沙雕的日常卡通找茬通关攻略分享 沙雕的日常卡通找茬怎么过关?卡通找茬这关是找茬玩法,主要考验大家的眼力,需要我们观察图片,找出10处不同。下面带来沙雕的日常卡通...

沙雕的日常卡通找茬通关攻略分享 沙雕的日常卡通找茬怎么过关?卡通找茬这关是找茬玩法,主要考验大家的眼力,需要我们观察图片,找出10处不同。下面带来沙雕的日常卡通... -

焦点热议:磨金石教育|冉冉升起的新星,现代恐怖片女王——米娅.高斯(上) 米娅 高斯(MiaGoth)是一位备受瞩目的年轻演员。过去几年,她在业界证明了自己是最具才华的表演者之一,并从丰富的配角角色逐渐晋升为主演,

焦点热议:磨金石教育|冉冉升起的新星,现代恐怖片女王——米娅.高斯(上) 米娅 高斯(MiaGoth)是一位备受瞩目的年轻演员。过去几年,她在业界证明了自己是最具才华的表演者之一,并从丰富的配角角色逐渐晋升为主演, -

吉米入沪 鲜香到家丨吉林大米、吉林鲜食玉米进上海社区活动成功举办! 春风十里,吉米飘香。4月19日,吉林大米、吉林鲜食玉米进上海社区暨点赞2023我最喜爱的中国品牌-吉林大米活动在上海市宜川街道社区文化活动

吉米入沪 鲜香到家丨吉林大米、吉林鲜食玉米进上海社区活动成功举办! 春风十里,吉米飘香。4月19日,吉林大米、吉林鲜食玉米进上海社区暨点赞2023我最喜爱的中国品牌-吉林大米活动在上海市宜川街道社区文化活动 -

通讯!汇丽B4月20日快速反弹 以下是汇丽B在北京时间4月20日10:51分盘口异动快照:4月20日,汇丽B盘中快速反弹,5分钟内涨幅超过2%,截至10点51分,报0 484元,成交3 68万元

通讯!汇丽B4月20日快速反弹 以下是汇丽B在北京时间4月20日10:51分盘口异动快照:4月20日,汇丽B盘中快速反弹,5分钟内涨幅超过2%,截至10点51分,报0 484元,成交3 68万元 -

乡村消费潜力加速释放 新业态成重要推动力量 乡村消费潜力加速释放新业态成重要推动力量---国家统计局最新发布的数据显示,一季度,社会消费品零售总额114922亿元,同比增长5 8%。具体来看

乡村消费潜力加速释放 新业态成重要推动力量 乡村消费潜力加速释放新业态成重要推动力量---国家统计局最新发布的数据显示,一季度,社会消费品零售总额114922亿元,同比增长5 8%。具体来看 -

澳门冠军赛8强席位争夺,跟随百岁山直击澳门冠军赛精彩时刻 4月20日,WTT澳门冠军赛进入第四天的争夺,国乒队全面奏凯。目前,马龙、陈梦率先进入男、女单八强。樊振东、梁靖崑、王楚钦、钱天一、王曼

澳门冠军赛8强席位争夺,跟随百岁山直击澳门冠军赛精彩时刻 4月20日,WTT澳门冠军赛进入第四天的争夺,国乒队全面奏凯。目前,马龙、陈梦率先进入男、女单八强。樊振东、梁靖崑、王楚钦、钱天一、王曼 -

宣亚国际4月20日盘中涨幅达5% 以下是宣亚国际在北京时间4月20日14:51分盘口异动快照:4月20日,宣亚国际盘中涨幅达5%,截至14点51分,报25 08元,成交4 07亿元,换手率10 51

宣亚国际4月20日盘中涨幅达5% 以下是宣亚国际在北京时间4月20日14:51分盘口异动快照:4月20日,宣亚国际盘中涨幅达5%,截至14点51分,报25 08元,成交4 07亿元,换手率10 51 -

星耀横店 为美而来|桃花面超级品牌盛典圆满成功 4月13日-4月14日由桃花面品牌管理集团举办的桃花面超级品牌盛典直播完美落幕这不仅是一场狂欢嗨购更是一次一对一明星护肤保养专访直播观看

星耀横店 为美而来|桃花面超级品牌盛典圆满成功 4月13日-4月14日由桃花面品牌管理集团举办的桃花面超级品牌盛典直播完美落幕这不仅是一场狂欢嗨购更是一次一对一明星护肤保养专访直播观看 -

第十三届中国道路交通安全产品博览会在长沙开幕 第十三届中国道路交通安全产品博览会暨公安交警警用装备展19日在长沙国际会展中心开幕,将系统介绍和展示我国道路交通安全领域的新技术、新

第十三届中国道路交通安全产品博览会在长沙开幕 第十三届中国道路交通安全产品博览会暨公安交警警用装备展19日在长沙国际会展中心开幕,将系统介绍和展示我国道路交通安全领域的新技术、新 -

视讯!一季度12家企业北交所IPO折戟,为何频现“一查就撤”? 今年一季度,北交所累计安排21家企业IPO上会,其中19家企业顺利过会,过会率超9成。与此同时,在北交所IPO审核“严把关”的背景之下,还...

视讯!一季度12家企业北交所IPO折戟,为何频现“一查就撤”? 今年一季度,北交所累计安排21家企业IPO上会,其中19家企业顺利过会,过会率超9成。与此同时,在北交所IPO审核“严把关”的背景之下,还... - 全国青少年体育俱乐部联赛精彩收官 疫情三年,我们参加比赛的机会不多,很荣幸参加这次比赛,与众多优秀选手切磋交流,对我来说是一次非常难得的机会,让我看到自己在技术的不

-

播报:Ubuntu 发行版更新 Linux 内核,修复 17 个安全漏洞

IT之家4月20日消息,Canonical于今天面向所有处于支持状态的Ubuntu发行版,发布了Linux内核安全更新,累计修复了17个安

播报:Ubuntu 发行版更新 Linux 内核,修复 17 个安全漏洞

IT之家4月20日消息,Canonical于今天面向所有处于支持状态的Ubuntu发行版,发布了Linux内核安全更新,累计修复了17个安 -

全球看热讯:四川绵阳红外相机捕捉到野外大熊猫“吃播”影像 近日,四川绵阳红外相机捕捉到野外大熊猫“吃播”影像。从画面中可以看到,一只大熊猫坐在红外相机前的雪地里,侧身拿了一根竹竿,嗅了...

全球看热讯:四川绵阳红外相机捕捉到野外大熊猫“吃播”影像 近日,四川绵阳红外相机捕捉到野外大熊猫“吃播”影像。从画面中可以看到,一只大熊猫坐在红外相机前的雪地里,侧身拿了一根竹竿,嗅了... -

世界通讯!宝马mini就冰淇淋不给中国人事件致歉:管理不细致引起不愉快 宝马mini就冰淇淋不给中国人事件致歉:管理不细致引起不愉快

世界通讯!宝马mini就冰淇淋不给中国人事件致歉:管理不细致引起不愉快 宝马mini就冰淇淋不给中国人事件致歉:管理不细致引起不愉快 -

焦点快播:迎国庆诗歌朗诵会方案_国庆节诗歌朗诵方案 1、国庆节朗诵:祖国颂《祖国颂》朗诵稿在世界的东方,有一个古老的国度,美丽而宽广,在世界的东方,有一个伟大

焦点快播:迎国庆诗歌朗诵会方案_国庆节诗歌朗诵方案 1、国庆节朗诵:祖国颂《祖国颂》朗诵稿在世界的东方,有一个古老的国度,美丽而宽广,在世界的东方,有一个伟大 -

世界新资讯:2023年抖音618有活动吗?降价力度大吗? 在抖音这个平台上面,大家一般也会去参加活动,因为抖音现在加入了电商功能,而且电商平台一般都会有活动推出,这是大家都知道的,2023年抖

世界新资讯:2023年抖音618有活动吗?降价力度大吗? 在抖音这个平台上面,大家一般也会去参加活动,因为抖音现在加入了电商功能,而且电商平台一般都会有活动推出,这是大家都知道的,2023年抖 -

上海车展重磅新车:款款都是精品 最近买车的不妨先看一看 上海车展重磅新车:款款都是精品最近买车的不妨先看一看

上海车展重磅新车:款款都是精品 最近买车的不妨先看一看 上海车展重磅新车:款款都是精品最近买车的不妨先看一看 -

杭州 2022 年亚运会电子竞技项目国家队开启人员推荐

IT之家4月20日消息,北京时间4月20日下午,杭州亚运会电子竞技各小项相关游戏厂商同时发布《关于第十九届杭州亚运会电子竞技项目国家集...

杭州 2022 年亚运会电子竞技项目国家队开启人员推荐

IT之家4月20日消息,北京时间4月20日下午,杭州亚运会电子竞技各小项相关游戏厂商同时发布《关于第十九届杭州亚运会电子竞技项目国家集... -

环球头条:手机淘宝如何种草?怎么操作? 我们在介绍一下自己用过的好产品,通过视频和图文的形式分享出来,然后粉丝就会去购买这些产品,那这种行为,就是叫种草。那么淘宝种...

环球头条:手机淘宝如何种草?怎么操作? 我们在介绍一下自己用过的好产品,通过视频和图文的形式分享出来,然后粉丝就会去购买这些产品,那这种行为,就是叫种草。那么淘宝种... -

每日精选:联发科「美好,万物同源」天玑影像展直播(视频)

直播主题:美好,万物同源天玑影像展直播简介:「美好,万物同源」天玑影像展,和保育人士一道,开启生态环境保护,人与自然和谐共生的...

每日精选:联发科「美好,万物同源」天玑影像展直播(视频)

直播主题:美好,万物同源天玑影像展直播简介:「美好,万物同源」天玑影像展,和保育人士一道,开启生态环境保护,人与自然和谐共生的... -

世界速讯:2023 华硕春季新品发布会直播(视频)

时间:2023年4月24日20:00产品:灵耀Pro142023、无畏Pro162023、ProArt创162023等机型华硕官方宣布,

世界速讯:2023 华硕春季新品发布会直播(视频)

时间:2023年4月24日20:00产品:灵耀Pro142023、无畏Pro162023、ProArt创162023等机型华硕官方宣布, -

小红书发布视频有收益吗?如何变现? 在小红书这个平台上面大家可以去发布视频也可以去发布一些内容帖子,这些如果大家的那种火了之后,有可能岱宗这个帐号游泳不错的流量...

小红书发布视频有收益吗?如何变现? 在小红书这个平台上面大家可以去发布视频也可以去发布一些内容帖子,这些如果大家的那种火了之后,有可能岱宗这个帐号游泳不错的流量... -

巨鹿是现在的哪个城市 巨鹿名字的由来是什么? 巨鹿是现在的哪个城市鹿县位置图 巨鹿县隶属河北省邢台市,总面积648平方公里,总人口36万人。曾获得过中国新能源产业百强县、全国美丽乡村

巨鹿是现在的哪个城市 巨鹿名字的由来是什么? 巨鹿是现在的哪个城市鹿县位置图 巨鹿县隶属河北省邢台市,总面积648平方公里,总人口36万人。曾获得过中国新能源产业百强县、全国美丽乡村 -

天天要闻:冰淇淋只给外国人?宝马mini被指区别对待:看ChatGPT帮宝马写声明 冰淇淋只给外国人?宝马mini被指区别对待:看ChatGPT帮宝马写声明

天天要闻:冰淇淋只给外国人?宝马mini被指区别对待:看ChatGPT帮宝马写声明 冰淇淋只给外国人?宝马mini被指区别对待:看ChatGPT帮宝马写声明 -

世界聚焦:淘特的商品质量怎么样?为什么这么便宜? 淘特的东西是真便宜,还是一般,跟拼多多来比差不多模式么。淘特之所以那么便宜是为什么?里面买东西是正品吗?下面给大家讲述一下。

世界聚焦:淘特的商品质量怎么样?为什么这么便宜? 淘特的东西是真便宜,还是一般,跟拼多多来比差不多模式么。淘特之所以那么便宜是为什么?里面买东西是正品吗?下面给大家讲述一下。 -

天天简讯:谷歌 Pixel Tablet 平板扩展坞亚马逊偷跑,售价 129 美元

IT之家4月20日消息,谷歌PixelTablet平板扩展坞已经在亚马逊平台偷跑,名称为“PixelTabletStandaloneChar

天天简讯:谷歌 Pixel Tablet 平板扩展坞亚马逊偷跑,售价 129 美元

IT之家4月20日消息,谷歌PixelTablet平板扩展坞已经在亚马逊平台偷跑,名称为“PixelTabletStandaloneChar -

买地的谦寻,抢手的滨江 曾经,不只一座城市想争夺直播电商产业的头把交椅,现在,“谁是中国直播电商第一城?”这个问题的答案,非杭州莫属。不过在杭州滨江,...

买地的谦寻,抢手的滨江 曾经,不只一座城市想争夺直播电商产业的头把交椅,现在,“谁是中国直播电商第一城?”这个问题的答案,非杭州莫属。不过在杭州滨江,... -

焦点观察:“云植”牌血塞通分散片出口海外 近日,云南植物药业有限公司“云植”牌血塞通分散片出口运输到达乌兹别克斯坦,实现了直接出口药品的突破。2022年10月,云植药业血塞通...

焦点观察:“云植”牌血塞通分散片出口海外 近日,云南植物药业有限公司“云植”牌血塞通分散片出口运输到达乌兹别克斯坦,实现了直接出口药品的突破。2022年10月,云植药业血塞通... -

2022年北京法院审结各类知识产权案件超7万件 居全国法院前列 20日,最高人民法院召开新闻发布会。北京市高级人民法院党组书记、院长寇昉介绍了2022年北京法院知识产权司法保护工作情况。2022年,北京法院

2022年北京法院审结各类知识产权案件超7万件 居全国法院前列 20日,最高人民法院召开新闻发布会。北京市高级人民法院党组书记、院长寇昉介绍了2022年北京法院知识产权司法保护工作情况。2022年,北京法院 -

播报:电脑qq如何扫码二维码(电脑qq怎么扫码二维码) 1、建议你登上手机qq后点我——设置——设备锁与账号安全——设备锁

播报:电脑qq如何扫码二维码(电脑qq怎么扫码二维码) 1、建议你登上手机qq后点我——设置——设备锁与账号安全——设备锁 -

环球新资讯:电解液添加剂价格回归“理性”,大客户“出走”,华一股份闯关IPO能否... 又一家新能源车产业链企业将上市。4月20日,苏州华一新能源科技股份有限公司(下称“华一股份”)将接受创业板上会审议。该公司主要从事...

环球新资讯:电解液添加剂价格回归“理性”,大客户“出走”,华一股份闯关IPO能否... 又一家新能源车产业链企业将上市。4月20日,苏州华一新能源科技股份有限公司(下称“华一股份”)将接受创业板上会审议。该公司主要从事... -

焦点快报!运满满快车“升级” 满帮集团短途(同城)货运新品牌“省省”来了 公路短途、同城货运赛道又新增一位实力选手。近日,满帮集团宣布正式升级短途(同城)货运品牌,上线全新“省省”APP,通过海量运力、优...

焦点快报!运满满快车“升级” 满帮集团短途(同城)货运新品牌“省省”来了 公路短途、同城货运赛道又新增一位实力选手。近日,满帮集团宣布正式升级短途(同城)货运品牌,上线全新“省省”APP,通过海量运力、优...

热门资讯

-

守正创新 逸乐途斩获CTJPA中国品牌创新奖 近日,由中国玩具和婴童用品协会(...

守正创新 逸乐途斩获CTJPA中国品牌创新奖 近日,由中国玩具和婴童用品协会(... -

吉米入沪 鲜香到家丨吉林大米、吉林鲜食玉米进上海社区活动成功举办! 春风十里,吉米飘香。4月19日,吉...

吉米入沪 鲜香到家丨吉林大米、吉林鲜食玉米进上海社区活动成功举办! 春风十里,吉米飘香。4月19日,吉... -

澳门冠军赛8强席位争夺,跟随百岁山直击澳门冠军赛精彩时刻 4月20日,WTT澳门冠军赛进入第四天...

澳门冠军赛8强席位争夺,跟随百岁山直击澳门冠军赛精彩时刻 4月20日,WTT澳门冠军赛进入第四天... -

星耀横店 为美而来|桃花面超级品牌盛典圆满成功 4月13日-4月14日由桃花面品牌管理...

星耀横店 为美而来|桃花面超级品牌盛典圆满成功 4月13日-4月14日由桃花面品牌管理...

观察

图片新闻

-

英媒:拜登政府外交失败暴露无遗 英国《泰晤士报》网站4月13日刊登...

英媒:拜登政府外交失败暴露无遗 英国《泰晤士报》网站4月13日刊登... -

天天快播:美民调:美国父母对枪支暴力担忧加剧 当地时间4月16日,根据美国哥伦比...

天天快播:美民调:美国父母对枪支暴力担忧加剧 当地时间4月16日,根据美国哥伦比... -

多部门联合印发推进铁水联运高质量发展行动方案 推动交通运输结构调整优化,是加快...

多部门联合印发推进铁水联运高质量发展行动方案 推动交通运输结构调整优化,是加快... -

神舟十五号乘组刷新中国航天员单个乘组出舱活动纪录 4月15日,神舟十五号航天员费俊龙...

神舟十五号乘组刷新中国航天员单个乘组出舱活动纪录 4月15日,神舟十五号航天员费俊龙...

精彩新闻

-

快讯:子宫托 子宫托是用于治疗妇女子宫脱垂的一...

快讯:子宫托 子宫托是用于治疗妇女子宫脱垂的一... -

视频号直播怎么挂商品?附注意事项 现在微信视频号可以直播带货,但...

视频号直播怎么挂商品?附注意事项 现在微信视频号可以直播带货,但... -

黄恒:广汽丰田后续全部产品将实现智能电动化 黄恒:广汽丰田后续全部产品将实现...

黄恒:广汽丰田后续全部产品将实现智能电动化 黄恒:广汽丰田后续全部产品将实现... -

Tony Gu专访集四:教你如何三步实现品牌战略落地 品牌战略落地B A D的核心理念公...

Tony Gu专访集四:教你如何三步实现品牌战略落地 品牌战略落地B A D的核心理念公... -

江苏:结对帮扶省内医疗资源薄弱地区 原标题:江苏:结对帮扶省内医疗资...

江苏:结对帮扶省内医疗资源薄弱地区 原标题:江苏:结对帮扶省内医疗资... -

动态焦点:印度第二家苹果 Apple Store 零售店在新德里开业,库克出席仪式

IT之家4月20日消息,当地时间4月20...

动态焦点:印度第二家苹果 Apple Store 零售店在新德里开业,库克出席仪式

IT之家4月20日消息,当地时间4月20... -

当前热点-马斯克:还没看到过任何外星人存在的证据,发现后我会立马发推

IT之家4月20日消息,SpaceX公司的...

当前热点-马斯克:还没看到过任何外星人存在的证据,发现后我会立马发推

IT之家4月20日消息,SpaceX公司的... -

环球今头条!上海车展拉开全球汽车变革序幕:燃油车已死 新能源车崛起 上海车展拉开全球汽车变革序幕:燃...

环球今头条!上海车展拉开全球汽车变革序幕:燃油车已死 新能源车崛起 上海车展拉开全球汽车变革序幕:燃... -

每日快看:生化危机之父三上真司通关《生化危机 4 重制版》,评价非常喜欢

IT之家4月20日消息,传奇游戏设计...

每日快看:生化危机之父三上真司通关《生化危机 4 重制版》,评价非常喜欢

IT之家4月20日消息,传奇游戏设计... -

适老家电“新蓝海” 品牌齐聚天猫同探“新机会“ 人口老龄化是经济社会发展的重要趋...

适老家电“新蓝海” 品牌齐聚天猫同探“新机会“ 人口老龄化是经济社会发展的重要趋... -

【环球播资讯】多多支付立减能用几次?金额是随机的吗? 为了能够更好的做好多多支付,那...

【环球播资讯】多多支付立减能用几次?金额是随机的吗? 为了能够更好的做好多多支付,那... -

《星球大战 绝地:幸存者》游戏开启 XSX 主机预加载,占用 140GB

IT之家4月20日消息,《星球大战绝...

《星球大战 绝地:幸存者》游戏开启 XSX 主机预加载,占用 140GB

IT之家4月20日消息,《星球大战绝... -

全球时讯:露露系列饮料生产基地落户杭州 总投资3.65亿元 承德露露4月19日晚间公告,随着南...

全球时讯:露露系列饮料生产基地落户杭州 总投资3.65亿元 承德露露4月19日晚间公告,随着南... -

天天热资讯!拼多多好评后不返现能举报吗?有哪些形式? 现在有很多小伙伴们在拼多多购物...

天天热资讯!拼多多好评后不返现能举报吗?有哪些形式? 现在有很多小伙伴们在拼多多购物... -

短讯!2023上海车展:劳斯莱斯新款幻影高定版亮相 2023上海车展期间,劳斯莱斯新款幻...

短讯!2023上海车展:劳斯莱斯新款幻影高定版亮相 2023上海车展期间,劳斯莱斯新款幻... -

环球短讯!单颗种植牙价格减半!医保部门今起展开种植牙价格综合治理 近日,多地医保部门发布公告,从今...

环球短讯!单颗种植牙价格减半!医保部门今起展开种植牙价格综合治理 近日,多地医保部门发布公告,从今... -

Unihertz TickTock-S 三防手机发布,可选腕表背屏/强光手电

IT之家4月20日消息,深圳市东方蓝...

Unihertz TickTock-S 三防手机发布,可选腕表背屏/强光手电

IT之家4月20日消息,深圳市东方蓝... -

【世界时快讯】湖北一季度铁路投资同比增三成 湖北日报讯(记者戴辉、通讯员冯杰...

【世界时快讯】湖北一季度铁路投资同比增三成 湖北日报讯(记者戴辉、通讯员冯杰... -

环球新资讯:安徽省郎溪县姚村市场监管所多举措整治餐饮浪费行为 为弘扬“厉行节约、反对浪费”的社...

环球新资讯:安徽省郎溪县姚村市场监管所多举措整治餐饮浪费行为 为弘扬“厉行节约、反对浪费”的社... -

红咖说专题导语 武汉这块广袤的土地上,孕育出了一...

红咖说专题导语 武汉这块广袤的土地上,孕育出了一... -

全球视讯!男士高档衣服品牌大全_男士衣服品牌大全 1、一线大牌:giorgioarmani,dior...

全球视讯!男士高档衣服品牌大全_男士衣服品牌大全 1、一线大牌:giorgioarmani,dior... -

融创房地产:免去两名董事职务 4月19日,融创房地产公告称,根据...

融创房地产:免去两名董事职务 4月19日,融创房地产公告称,根据... -

【全球热闻】国家统计局报告:儿童安全保护持续加强 受教育水平稳步提升 央视网消息:据国家统计局,2021年...

【全球热闻】国家统计局报告:儿童安全保护持续加强 受教育水平稳步提升 央视网消息:据国家统计局,2021年... -

每日速看!中兴Axon 40 Lite手机发布:搭载紫光展锐T616,售3999墨西哥比索

IT之家4月20日消息,据GIZMOCHINA...

每日速看!中兴Axon 40 Lite手机发布:搭载紫光展锐T616,售3999墨西哥比索

IT之家4月20日消息,据GIZMOCHINA... -

焦点!芯片龙头的低谷期,一个关键指标正在转好 21世纪经济报道记者张赛男上海报道...

焦点!芯片龙头的低谷期,一个关键指标正在转好 21世纪经济报道记者张赛男上海报道... -

环球微速讯:微软 Outlook 应用预览 Authenticator Lite 工具,可无密码登录

IT之家4月20日消息,根据微软官方...

环球微速讯:微软 Outlook 应用预览 Authenticator Lite 工具,可无密码登录

IT之家4月20日消息,根据微软官方... -

提森博物馆首次携镇馆之宝来华,打开跨越600年的“西方艺术百科全书” 上海将再迎重磅海外大展!6月22日...

提森博物馆首次携镇馆之宝来华,打开跨越600年的“西方艺术百科全书” 上海将再迎重磅海外大展!6月22日... -

大学生创业沙龙活动进校园 大学生创业沙龙活动进校园

大学生创业沙龙活动进校园 大学生创业沙龙活动进校园 -

《哥斯拉大战金刚2:帝国崛起》官宣,预计2024年3月15日北美上映

IT之家4月20日消息,传奇东方影业...

《哥斯拉大战金刚2:帝国崛起》官宣,预计2024年3月15日北美上映

IT之家4月20日消息,传奇东方影业... -

微软调整 Outlook 邮件应用链接长度上限:最长 8192 个字符

IT之家4月20日消息,微软Outlook电...

微软调整 Outlook 邮件应用链接长度上限:最长 8192 个字符

IT之家4月20日消息,微软Outlook电... -

今日热议:东方铁塔2022年净利润翻倍增长 今年上半年将实现年产百万吨氯化钾达产达标 东方铁塔(002545)4月19日晚间披露2...

今日热议:东方铁塔2022年净利润翻倍增长 今年上半年将实现年产百万吨氯化钾达产达标 东方铁塔(002545)4月19日晚间披露2... -

当前看点!陕西新增3处国家考古遗址公园 记者从陕西省文物局获悉:4月18日...

当前看点!陕西新增3处国家考古遗址公园 记者从陕西省文物局获悉:4月18日... -

全球今亮点!美图秀秀 iOS 端 9.8.60 版本发布:新增 AI 文生图功能

IT之家4月20日消息,据IT之家网友...

全球今亮点!美图秀秀 iOS 端 9.8.60 版本发布:新增 AI 文生图功能

IT之家4月20日消息,据IT之家网友... -

第81届中国教育装备展示会将在南昌举办 4月19日下午,第81届中国教育装备...

第81届中国教育装备展示会将在南昌举办 4月19日下午,第81届中国教育装备... -

湖南洞口:村级课堂“摆擂台”,“支书比武”展风采 日前,一场别开生面的“支书大比武...

湖南洞口:村级课堂“摆擂台”,“支书比武”展风采 日前,一场别开生面的“支书大比武... -

“复兴号”开进秦巴小站 让山区群众出行不再难 人民网西安4月18日电(邓楠、贾凯...

“复兴号”开进秦巴小站 让山区群众出行不再难 人民网西安4月18日电(邓楠、贾凯... -

65岁老人染赌博恶习!绑架亲外孙开价勒索50万 “限你三天内拿出50万元,否则就再...

65岁老人染赌博恶习!绑架亲外孙开价勒索50万 “限你三天内拿出50万元,否则就再... -

全球即时看!安徽7个产业集群入选中国百强 近日,2023中国民营经济发展论坛发...

全球即时看!安徽7个产业集群入选中国百强 近日,2023中国民营经济发展论坛发... -

巨潮科技2022年净利404.94万同比下滑51.87% 销售费用上涨 巨潮科技2022年净利404 94万同比...

巨潮科技2022年净利404.94万同比下滑51.87% 销售费用上涨 巨潮科技2022年净利404 94万同比... -

52.56亿融资方案出炉 看REITs扩募里的估值细节 4月17日至18日,首批4只基础设施公...

52.56亿融资方案出炉 看REITs扩募里的估值细节 4月17日至18日,首批4只基础设施公... -

每日精选:甘肃崇信消防开展杨柳絮火灾防控宣传工作 为全面做好杨柳絮火灾防控工作,近...

每日精选:甘肃崇信消防开展杨柳絮火灾防控宣传工作 为全面做好杨柳絮火灾防控工作,近... -

天天即时看!剑桥分析丑闻后续:Meta 公司启动 7.25 亿美元赔付程序

IT之家4月20日消息,Meta公司于202...

天天即时看!剑桥分析丑闻后续:Meta 公司启动 7.25 亿美元赔付程序

IT之家4月20日消息,Meta公司于202... -

支持民企发展公平是关键 近期,多地加快制定民营经济促进条...

支持民企发展公平是关键 近期,多地加快制定民营经济促进条... -

世界视点!淘宝注销店铺后可以重新注册吗?注销店铺条件有哪些? 在淘宝开店的商家非常多,商家如果...

世界视点!淘宝注销店铺后可以重新注册吗?注销店铺条件有哪些? 在淘宝开店的商家非常多,商家如果... -

京东24期免息券怎么领取?有服务费怎么回事? 目前京东平台上购物的消费者是有...

京东24期免息券怎么领取?有服务费怎么回事? 目前京东平台上购物的消费者是有... -

仙剑奇侠传 IP 首款开放世界手游:《仙剑世界》开启预约

IT之家4月20日消息,CMGE中手游今...

仙剑奇侠传 IP 首款开放世界手游:《仙剑世界》开启预约

IT之家4月20日消息,CMGE中手游今... -

“破圈”协作,通关更便捷 全国哪个区域占中国经济总量的比重...

“破圈”协作,通关更便捷 全国哪个区域占中国经济总量的比重... -

世界快资讯丨京东预售便宜还是618当天便宜?为什么? 距离京东618活动已经没有多长时间...

世界快资讯丨京东预售便宜还是618当天便宜?为什么? 距离京东618活动已经没有多长时间... -

动态:价格崩了!全新日产天籁直降4.9万:不到14万可买合资中型轿车 价格崩了!全新日产天籁直降4 9万...

动态:价格崩了!全新日产天籁直降4.9万:不到14万可买合资中型轿车 价格崩了!全新日产天籁直降4 9万... -

播报:京东订单如何催单?好多才能回复? 目前对京东卖家来说,如果订单一...

播报:京东订单如何催单?好多才能回复? 目前对京东卖家来说,如果订单一...