热点在线丨商汤科技发布多模态通用大模型“书生 2.5”

IT之家 3 月 14 日消息,商汤科技于今日发布了多模态多任务通用大模型“书生(INTERN)2.5”,拥有 30 亿参数,号称是目前全球开源模型中 ImageNet 准确度最高、规模最大,同时也是物体检测标杆数据集 COCO 中唯一超过 65.0 mAP 的模型。

【资料图】

【资料图】

据介绍,“书生 2.5”的图文跨模态开放任务处理能力可为自动驾驶、机器人等通用场景任务提供高效精准的感知和理解能力支持。“书生”由商汤科技、上海人工智能实验室、清华大学、香港中文大学、上海交通大学于 2021 年 11 月首次共同发布,并持续联合研发。

改进方面,“书生 2.5”实现了通过文本来定义任务,从而可以灵活地定义不同场景的任务需求,并根据给定视觉图像和任务的提示性语句,给出相应的指令或作答,进而具备通用场景下的高级感知和复杂问题处理能力,比如图像描述、视觉问答、视觉推理和文字识别等。

在自动驾驶和居家机器人等通用场景下,“书生 2.5”可辅助处理各种复杂任务。

例如,在自动驾驶场景中,可以大幅提升场景感知理解能力,准确辅助车辆判断交通信号灯状态、道路标志牌等信息,为车辆决策规划提供有效信息输入。

▲ 利用多模态多任务通用大模型辅助完成自动驾驶场景中各类复杂任务

▲ 利用多模态多任务通用大模型辅助完成居家机器人场景中各类复杂任务

除解决自动驾驶和居家机器人这类复杂问题的能力,“书生 2.5”通用大模型也可解决纷繁复杂的日常生活中的常见任务,满足各种需求。

除全图级别的以图生文,“书生 2.5”通用大模型同样可根据物体边框更精细化定位任务需求。

“书生 2.5”同时具备 AIGC“以文生图”的能力。可根据用户提出的文本创作需求,利用扩散模型生成算法,生成高质量、自然的写实图像。

例如,借助“书生 2.5”的以文生图能力帮助自动驾驶技术研发,通过生成各类真实的道路交通场景,如繁忙的城市街道、雨天拥挤车道、马路上奔跑的狗等,生成写实的 Corner Case 训练数据,进而训练自动驾驶系统对 Corner Case 场景的感知能力上限。

“书生 2.5”还可根据文本快速检索出视觉内容。

例如,可在相册中返回文本所指定的相关图像,或是在视频中检索出与文本描述最相关的帧,提高视频中时间定位任务的效率。此外还支持引入物体检测框,根据文本返回最相关的物体,实现开放世界视频或图像中物体检测及视觉定位。

即日起,“书生 2.5”多模态通用大模型已在商汤参与的通用视觉开源平台 OpenGVLab 开源,IT之家附 GitHub 仓库访问链接。

标签:

-

热点在线丨商汤科技发布多模态通用大模型“书生 2.5”

IT之家3月14日消息,商汤科技于今日发布了多模态多任务通用大模型“书生(INTERN)2 5”,拥有30亿参数,号称是目前全球开源模型中Imag

热点在线丨商汤科技发布多模态通用大模型“书生 2.5”

IT之家3月14日消息,商汤科技于今日发布了多模态多任务通用大模型“书生(INTERN)2 5”,拥有30亿参数,号称是目前全球开源模型中Imag -

重点聚焦!我国已完全掌握量子计算用极低温稀释制冷机关键核心技术

IT之家3月14日消息,据安徽大学融媒体中心消息,2022年12月31日,安徽大学完全自主研发的量子计算用极低温稀释制冷机,经过反复严格测试

重点聚焦!我国已完全掌握量子计算用极低温稀释制冷机关键核心技术

IT之家3月14日消息,据安徽大学融媒体中心消息,2022年12月31日,安徽大学完全自主研发的量子计算用极低温稀释制冷机,经过反复严格测试 -

微速讯:华硕灵耀 14 2023 旗舰版笔记本上架:14.5英寸2.8K 120Hz屏

IT之家3月14日消息,华硕灵耀142023旗舰版笔记本将在3月16日发布,其京东商品页面现已上线。据京东页面,华硕灵耀142023

微速讯:华硕灵耀 14 2023 旗舰版笔记本上架:14.5英寸2.8K 120Hz屏

IT之家3月14日消息,华硕灵耀142023旗舰版笔记本将在3月16日发布,其京东商品页面现已上线。据京东页面,华硕灵耀142023 -

世界微动态丨联想小新 Pro 16 《原子之心》测试:680M 核显低画质 2.5K 60fps

IT之家3月14日消息,联想官方今日用最新的发布的小新Pro162023锐龙版和酷睿独显版测试了《原子之心》游戏,测试结果显示两款型号均可流畅运

世界微动态丨联想小新 Pro 16 《原子之心》测试:680M 核显低画质 2.5K 60fps

IT之家3月14日消息,联想官方今日用最新的发布的小新Pro162023锐龙版和酷睿独显版测试了《原子之心》游戏,测试结果显示两款型号均可流畅运 -

播报:Ubuntu 23.04 用上 Linux 6.2 内核,预计下放到 22.04 LTS 版本

IT之家3月14日消息,据OMG!Ubuntu!报道,最近的Ubuntu邮件显示,Ubuntu23 04“LunarLobster”版本,

播报:Ubuntu 23.04 用上 Linux 6.2 内核,预计下放到 22.04 LTS 版本

IT之家3月14日消息,据OMG!Ubuntu!报道,最近的Ubuntu邮件显示,Ubuntu23 04“LunarLobster”版本, -

当前视点!《碟中谍 7:致命清算(上)》首曝海报,7 月 14 日北美上映

IT之家3月14日消息,《碟中谍7:致命清算(上)》今日首曝海报,阿汤哥再次执行更加棘手的致命任务。《碟中谍7:致命清算(上)》由克里斯托夫

当前视点!《碟中谍 7:致命清算(上)》首曝海报,7 月 14 日北美上映

IT之家3月14日消息,《碟中谍7:致命清算(上)》今日首曝海报,阿汤哥再次执行更加棘手的致命任务。《碟中谍7:致命清算(上)》由克里斯托夫

-

热点在线丨商汤科技发布多模态通用大模型“书生 2.5”

IT之家3月14日消息,商汤科技于今日发布了多模态多任务通用大模型“书生(INTERN)2 5”,拥有30亿参数,号称是目前全球开源模型中Imag

热点在线丨商汤科技发布多模态通用大模型“书生 2.5”

IT之家3月14日消息,商汤科技于今日发布了多模态多任务通用大模型“书生(INTERN)2 5”,拥有30亿参数,号称是目前全球开源模型中Imag -

重点聚焦!我国已完全掌握量子计算用极低温稀释制冷机关键核心技术

IT之家3月14日消息,据安徽大学融媒体中心消息,2022年12月31日,安徽大学完全自主研发的量子计算用极低温稀释制冷机,经过反复严格测试

重点聚焦!我国已完全掌握量子计算用极低温稀释制冷机关键核心技术

IT之家3月14日消息,据安徽大学融媒体中心消息,2022年12月31日,安徽大学完全自主研发的量子计算用极低温稀释制冷机,经过反复严格测试 -

微速讯:华硕灵耀 14 2023 旗舰版笔记本上架:14.5英寸2.8K 120Hz屏

IT之家3月14日消息,华硕灵耀142023旗舰版笔记本将在3月16日发布,其京东商品页面现已上线。据京东页面,华硕灵耀142023

微速讯:华硕灵耀 14 2023 旗舰版笔记本上架:14.5英寸2.8K 120Hz屏

IT之家3月14日消息,华硕灵耀142023旗舰版笔记本将在3月16日发布,其京东商品页面现已上线。据京东页面,华硕灵耀142023 -

全球新动态:Meta 再次大裁员削减 1 万人,并关闭 5000 个空缺职位

IT之家3月14日消息,Facebook母公司Meta于周二表示,将裁员10000人,距离上次裁员11000人仅仅四个月,这是第一家宣布第

全球新动态:Meta 再次大裁员削减 1 万人,并关闭 5000 个空缺职位

IT之家3月14日消息,Facebook母公司Meta于周二表示,将裁员10000人,距离上次裁员11000人仅仅四个月,这是第一家宣布第 -

当前视点!《碟中谍 7:致命清算(上)》首曝海报,7 月 14 日北美上映

IT之家3月14日消息,《碟中谍7:致命清算(上)》今日首曝海报,阿汤哥再次执行更加棘手的致命任务。《碟中谍7:致命清算(上)》由克里斯托夫

当前视点!《碟中谍 7:致命清算(上)》首曝海报,7 月 14 日北美上映

IT之家3月14日消息,《碟中谍7:致命清算(上)》今日首曝海报,阿汤哥再次执行更加棘手的致命任务。《碟中谍7:致命清算(上)》由克里斯托夫 -

当前消息!LG gram 14 2023 款轻薄本上架:仅重 999g,首发价 8999 元起

IT之家3月14日消息,LGgram142023款轻薄本现已上架,搭载13代酷睿i5 i7处理器,首发价8999元起。LGgr

当前消息!LG gram 14 2023 款轻薄本上架:仅重 999g,首发价 8999 元起

IT之家3月14日消息,LGgram142023款轻薄本现已上架,搭载13代酷睿i5 i7处理器,首发价8999元起。LGgr -

播报:Ubuntu 23.04 用上 Linux 6.2 内核,预计下放到 22.04 LTS 版本

IT之家3月14日消息,据OMG!Ubuntu!报道,最近的Ubuntu邮件显示,Ubuntu23 04“LunarLobster”版本,

播报:Ubuntu 23.04 用上 Linux 6.2 内核,预计下放到 22.04 LTS 版本

IT之家3月14日消息,据OMG!Ubuntu!报道,最近的Ubuntu邮件显示,Ubuntu23 04“LunarLobster”版本, -

世界微动态丨联想小新 Pro 16 《原子之心》测试:680M 核显低画质 2.5K 60fps

IT之家3月14日消息,联想官方今日用最新的发布的小新Pro162023锐龙版和酷睿独显版测试了《原子之心》游戏,测试结果显示两款型号均可流畅运

世界微动态丨联想小新 Pro 16 《原子之心》测试:680M 核显低画质 2.5K 60fps

IT之家3月14日消息,联想官方今日用最新的发布的小新Pro162023锐龙版和酷睿独显版测试了《原子之心》游戏,测试结果显示两款型号均可流畅运 -

【快播报】西咸新区审计局多措并举积极推进审计整改工作 助力高质量发展 为推动审计查出问题整改落实,促进审计成果运用,西咸新区审计局多措并举积极推进审计整改工作,切实做好审计工作“后半篇文章”,更好...

【快播报】西咸新区审计局多措并举积极推进审计整改工作 助力高质量发展 为推动审计查出问题整改落实,促进审计成果运用,西咸新区审计局多措并举积极推进审计整改工作,切实做好审计工作“后半篇文章”,更好... -

天天速读:网件推出旗下首款 Wi-Fi 7 路由器Nighthawk RS700,售价700美元

IT之家3月14日消息,网件(Netgear)今天发布了其首款Wi-Fi7产品——NighthawkRS700无线路由器。Wi-Fi7为

天天速读:网件推出旗下首款 Wi-Fi 7 路由器Nighthawk RS700,售价700美元

IT之家3月14日消息,网件(Netgear)今天发布了其首款Wi-Fi7产品——NighthawkRS700无线路由器。Wi-Fi7为 -

环球速看:高通推出全球首款支持四大主要操作系统的集成式 5G 物联网处理器

IT之家3月14日消息,IT之家从高通中国官方公众号获悉,今日,高通技术公司宣布推出全球首款为支持四大主要操作系统而设计的集成式5G物联网处理

环球速看:高通推出全球首款支持四大主要操作系统的集成式 5G 物联网处理器

IT之家3月14日消息,IT之家从高通中国官方公众号获悉,今日,高通技术公司宣布推出全球首款为支持四大主要操作系统而设计的集成式5G物联网处理 -

当前关注:我“嘉”对话框:她力量 对话,是人类情感最显性的表达。有柴米油盐的细碎,有喜怒哀乐的强烈。能描绘庙堂之高的宏大,也能演绎江湖之远的恬淡。我嘉对话框,用...

当前关注:我“嘉”对话框:她力量 对话,是人类情感最显性的表达。有柴米油盐的细碎,有喜怒哀乐的强烈。能描绘庙堂之高的宏大,也能演绎江湖之远的恬淡。我嘉对话框,用... -

今日热讯:微博开展为期 2 个月的“自媒体”专项治理行动

IT之家3月14日消息,IT之家此前报道,按照2023年“清朗”系列专项行动计划,中央网信办自3月12日起,开展为期两个月的“清朗・从严整治

今日热讯:微博开展为期 2 个月的“自媒体”专项治理行动

IT之家3月14日消息,IT之家此前报道,按照2023年“清朗”系列专项行动计划,中央网信办自3月12日起,开展为期两个月的“清朗・从严整治 -

专家建议:肿瘤基因检测行业发展迅速 亟需进一步规范管理 近年来,随着肿瘤患者对肿瘤基因检测的需求不断上升,相关行业得以迅速发展,但与此同时,基因检测行业发展亟待进一步规范管理。为推动...

专家建议:肿瘤基因检测行业发展迅速 亟需进一步规范管理 近年来,随着肿瘤患者对肿瘤基因检测的需求不断上升,相关行业得以迅速发展,但与此同时,基因检测行业发展亟待进一步规范管理。为推动... -

新疆若羌:“小拱棚”寄托增收“大希望” 今年以来,新疆若羌县吾塔木乡昆其村把发展“庭院经济”作为推进乡村振兴战略和巩固脱贫攻坚成果的重要抓手,创新理念,利用农户房前屋...

新疆若羌:“小拱棚”寄托增收“大希望” 今年以来,新疆若羌县吾塔木乡昆其村把发展“庭院经济”作为推进乡村振兴战略和巩固脱贫攻坚成果的重要抓手,创新理念,利用农户房前屋... -

环球焦点!漫威要求谷歌协助调查《蚁人与黄蜂女:量子狂潮》台词泄露事件

IT之家3月14日消息,在《蚁人与黄蜂女:量子狂潮》上映前近一个月,Reddit上出现了一份谷歌文档,其中似乎是电影的完整对话台词。近日,漫威已

环球焦点!漫威要求谷歌协助调查《蚁人与黄蜂女:量子狂潮》台词泄露事件

IT之家3月14日消息,在《蚁人与黄蜂女:量子狂潮》上映前近一个月,Reddit上出现了一份谷歌文档,其中似乎是电影的完整对话台词。近日,漫威已 -

全球消息!床上用品三件套和四件套的区别_床上用品三件套包括什么及如何选购 1、 三件套是一种家装饰品。三件套指的是床单、被套、枕套。以下是小编为大家整理的床上用品三件套包括什么及如何选购,希望

全球消息!床上用品三件套和四件套的区别_床上用品三件套包括什么及如何选购 1、 三件套是一种家装饰品。三件套指的是床单、被套、枕套。以下是小编为大家整理的床上用品三件套包括什么及如何选购,希望 -

尉犁县:深化户政“放管服”改革 提升群众满意度 刘娜是新疆尉犁县衡水中学尉犁分校的学生,因身份证马上要过期了,来到窗口办理身份证到期更换业务。从登记、核对信息、拍照到出示领取...

尉犁县:深化户政“放管服”改革 提升群众满意度 刘娜是新疆尉犁县衡水中学尉犁分校的学生,因身份证马上要过期了,来到窗口办理身份证到期更换业务。从登记、核对信息、拍照到出示领取... -

天天短讯!秦汉新城持续开展政银企对接活动 以金融服务助力企业发展 日前,陕西迪泰克新材料有限公司顺利完成近亿元B轮融资,此次融资由中科创星领投,陕西金资、镭融基金等跟投。无独有偶,在3月10日秦创原(秦

天天短讯!秦汉新城持续开展政银企对接活动 以金融服务助力企业发展 日前,陕西迪泰克新材料有限公司顺利完成近亿元B轮融资,此次融资由中科创星领投,陕西金资、镭融基金等跟投。无独有偶,在3月10日秦创原(秦 -

世界简讯:网络诈骗太猖獗,FBI 称 2022 年美国人被骗了 103 亿美元

IT之家3月14日消息,根据美国联邦调查局(FBI)本月发布的一份报告,去年美国人因各种网络诈骗损失了103亿美元(IT之家备注:当前约706 5

世界简讯:网络诈骗太猖獗,FBI 称 2022 年美国人被骗了 103 亿美元

IT之家3月14日消息,根据美国联邦调查局(FBI)本月发布的一份报告,去年美国人因各种网络诈骗损失了103亿美元(IT之家备注:当前约706 5 -

环球观速讯丨消息称英伟达 RTX 4070 显卡 4 月 12 日发布,次日上市

IT之家3月14日消息,据VideoCardz消息,英伟达将于4月12日正式发布GeForceRTX4070显卡,4月13日上

环球观速讯丨消息称英伟达 RTX 4070 显卡 4 月 12 日发布,次日上市

IT之家3月14日消息,据VideoCardz消息,英伟达将于4月12日正式发布GeForceRTX4070显卡,4月13日上 -

唯卓仕 99Wh V 口锂电池发布:双向 PD 45W 快充,首发价 699 元

IT之家3月14日消息,Viltrox唯卓仕推出了一款99WhV口锂电池,首发价699元。该电池型号为BP-V99,拥有99Wh(14

唯卓仕 99Wh V 口锂电池发布:双向 PD 45W 快充,首发价 699 元

IT之家3月14日消息,Viltrox唯卓仕推出了一款99WhV口锂电池,首发价699元。该电池型号为BP-V99,拥有99Wh(14 -

【独家】西方军援不断!乌克兰已成全球第三大武器“买家” 中新网3月14日电据“今日俄罗斯”(RT)报道,瑞典斯德哥尔摩国际和平研究所当地时间13日公布的数据显示,美国和欧盟国家在乌克兰危机之际...

【独家】西方军援不断!乌克兰已成全球第三大武器“买家” 中新网3月14日电据“今日俄罗斯”(RT)报道,瑞典斯德哥尔摩国际和平研究所当地时间13日公布的数据显示,美国和欧盟国家在乌克兰危机之际... -

全球消息!西安阎良区、航空基地、航天基地“产能释放”小分队深入广州、深圳拓市... 三月的羊城气候宜人。在广州开发区科技企业加速器园区内立有一块巨石,上面清晰地镌刻着8个醒目大字,“中小企业能办大事”,激励着广大...

全球消息!西安阎良区、航空基地、航天基地“产能释放”小分队深入广州、深圳拓市... 三月的羊城气候宜人。在广州开发区科技企业加速器园区内立有一块巨石,上面清晰地镌刻着8个醒目大字,“中小企业能办大事”,激励着广大... -

快播:广西钦州:灯光璀璨 夜景如画 白石湖公园全景(央广网发钦州市委宣传部供图)近年来,广西钦州市着力实施城市品质提升行动,城市面貌日新月异,市民的幸福感、获得感...

快播:广西钦州:灯光璀璨 夜景如画 白石湖公园全景(央广网发钦州市委宣传部供图)近年来,广西钦州市着力实施城市品质提升行动,城市面貌日新月异,市民的幸福感、获得感... -

全球热消息:阿克苏市:戏曲进社区家门口过足“瘾” “老师们唱得太好了!在家门口看现场演出,可比手机上看精彩得多!”家住新疆阿克苏市巨龙社区的戏迷王春华高兴地说。为弘扬中华优秀传...

全球热消息:阿克苏市:戏曲进社区家门口过足“瘾” “老师们唱得太好了!在家门口看现场演出,可比手机上看精彩得多!”家住新疆阿克苏市巨龙社区的戏迷王春华高兴地说。为弘扬中华优秀传... -

今日热门!LG 公布新款 32GQ750 显示器:31.5 英寸 4K 144Hz VA 屏

IT之家3月14日消息,LG现已公布新款GQ系列显示器,型号为32GQ750,31 5英寸4K144HzVA屏,预计将在不久后上市。参

今日热门!LG 公布新款 32GQ750 显示器:31.5 英寸 4K 144Hz VA 屏

IT之家3月14日消息,LG现已公布新款GQ系列显示器,型号为32GQ750,31 5英寸4K144HzVA屏,预计将在不久后上市。参 -

环球快报:西安市莲湖区:以高质量组织工作助推全区经济社会高质量发展 2023年以来,西安市莲湖区立足本职,深入贯彻落实新时代党的组织路线,以莲湖组织工作优势助推莲湖经济社会高质量发展。用好“五微课堂...

环球快报:西安市莲湖区:以高质量组织工作助推全区经济社会高质量发展 2023年以来,西安市莲湖区立足本职,深入贯彻落实新时代党的组织路线,以莲湖组织工作优势助推莲湖经济社会高质量发展。用好“五微课堂... -

网信中国发布“地图导航类”App 个人信息收集情况测试报告

IT之家3月14日消息,网信中国在公众号发布《“地图导航类”App个人信息收集情况测试报告》,提到中国网络空间安全协会、国家计算机网络...

网信中国发布“地图导航类”App 个人信息收集情况测试报告

IT之家3月14日消息,网信中国在公众号发布《“地图导航类”App个人信息收集情况测试报告》,提到中国网络空间安全协会、国家计算机网络... -

每日关注!淘宝推广怎么做挣佣金?有哪些方法? 来越多的人开始靠网络赚钱了,不论是知识付费还是内容营销收入都是不错的,其中利用淘宝赚钱的人最多,有的人之间开网店,有的人则是...

每日关注!淘宝推广怎么做挣佣金?有哪些方法? 来越多的人开始靠网络赚钱了,不论是知识付费还是内容营销收入都是不错的,其中利用淘宝赚钱的人最多,有的人之间开网店,有的人则是... -

今日精选:新手游即将上线,动视承诺将长期支持原版《使命召唤手游》

IT之家3月14日消息,微软此前在交给英国竞争和市场管理局的资料中提到,计划在中国大陆地区以外用新的《使命召唤:战争地带手游》(CallofDuty

今日精选:新手游即将上线,动视承诺将长期支持原版《使命召唤手游》

IT之家3月14日消息,微软此前在交给英国竞争和市场管理局的资料中提到,计划在中国大陆地区以外用新的《使命召唤:战争地带手游》(CallofDuty -

抖音抖币可以提现吗?直播的收入怎么计算? 在抖音很多小伙伴们都会有自己喜欢的主播,那么看到喜欢的主播,大家就想要给他送礼物,送的礼物都是需要通过抖币去购买的,抖币可以...

抖音抖币可以提现吗?直播的收入怎么计算? 在抖音很多小伙伴们都会有自己喜欢的主播,那么看到喜欢的主播,大家就想要给他送礼物,送的礼物都是需要通过抖币去购买的,抖币可以... -

化粪池的规格类型有哪些? 不同化粪池的优点混凝土化粪池具有坚固耐用、使用寿命长的特点,但制造和安装比较麻烦;混凝土化粪池是由三个相互连通的密封粪池组成,粪...

化粪池的规格类型有哪些? 不同化粪池的优点混凝土化粪池具有坚固耐用、使用寿命长的特点,但制造和安装比较麻烦;混凝土化粪池是由三个相互连通的密封粪池组成,粪... -

南宁市武鸣区:警务改革成果惠民 群众安全感再创新高 2022年以来,南宁市公安局武鸣分局坚定不移走改革强警之路,切实让公安警务改革成果惠及人民,不断提高武鸣区人民群众的获得感、幸福感和安全

南宁市武鸣区:警务改革成果惠民 群众安全感再创新高 2022年以来,南宁市公安局武鸣分局坚定不移走改革强警之路,切实让公安警务改革成果惠及人民,不断提高武鸣区人民群众的获得感、幸福感和安全 -

每日动态!淘宝特价版开店费用是多少?入驻条件是什么? 淘宝现在在大力推广它的特价版淘宝,因为随着拼多多的崛起,很多客户都引流到拼多多了,很多人喜欢在拼多多上购买了,所以为了抵抗拼...

每日动态!淘宝特价版开店费用是多少?入驻条件是什么? 淘宝现在在大力推广它的特价版淘宝,因为随着拼多多的崛起,很多客户都引流到拼多多了,很多人喜欢在拼多多上购买了,所以为了抵抗拼... -

研究:AlphaGo 推动人类围棋选手变得更有创造力

IT之家3月14日消息,今年早些时候,一位业余围棋选手以压倒性的优势击败了一款顶尖的围棋人工智能系统。他是利用了一款由研究人员设计的...

研究:AlphaGo 推动人类围棋选手变得更有创造力

IT之家3月14日消息,今年早些时候,一位业余围棋选手以压倒性的优势击败了一款顶尖的围棋人工智能系统。他是利用了一款由研究人员设计的... -

当前热议!华硕推出 Tinker Board 3 开发板,搭载瑞芯微 RK3568 四核处理器

IT之家3月14日消息,华硕IoT物联网部门在德国的EmbeddedWorld2023(国际嵌入式展)上发布了新款TinkerBoard

当前热议!华硕推出 Tinker Board 3 开发板,搭载瑞芯微 RK3568 四核处理器

IT之家3月14日消息,华硕IoT物联网部门在德国的EmbeddedWorld2023(国际嵌入式展)上发布了新款TinkerBoard -

快播:沈阳外卖小哥获聘食品安全“吹哨人” 央广网沈阳3月14日消息(见习记者李子平)3月14日,辽宁省暨沈阳市“3·15”国际消费者权益日食品安全宣传活动在沈阳中街举行。活动现场...

快播:沈阳外卖小哥获聘食品安全“吹哨人” 央广网沈阳3月14日消息(见习记者李子平)3月14日,辽宁省暨沈阳市“3·15”国际消费者权益日食品安全宣传活动在沈阳中街举行。活动现场... -

俄罗斯贝加尔湖位置_俄罗斯贝加尔湖 1、贝加尔湖湖型狭长弯曲,宛如一弯新月,所以又有“月亮湖”之称。2、它长636千米,平均宽48千米,最宽79 4千米,面

俄罗斯贝加尔湖位置_俄罗斯贝加尔湖 1、贝加尔湖湖型狭长弯曲,宛如一弯新月,所以又有“月亮湖”之称。2、它长636千米,平均宽48千米,最宽79 4千米,面 -

世界信息:农村养鸡简易棚怎么搭的? 搭建农村养鸡简易棚的步骤选择平整、通风、阳光充足的场地,同时需要考虑周围环境是否有污染源,如化工厂、污水处理厂等。另外建设地点...

世界信息:农村养鸡简易棚怎么搭的? 搭建农村养鸡简易棚的步骤选择平整、通风、阳光充足的场地,同时需要考虑周围环境是否有污染源,如化工厂、污水处理厂等。另外建设地点... -

扬州市友协召开第三届理事会第三次会议 3月13日,江苏省扬州市人民对外友好协会第三届理事会第三次会议召开,深入学习贯彻党的二十大精神,总结2022年的工作,科学谋划下一阶段全市对

扬州市友协召开第三届理事会第三次会议 3月13日,江苏省扬州市人民对外友好协会第三届理事会第三次会议召开,深入学习贯彻党的二十大精神,总结2022年的工作,科学谋划下一阶段全市对 -

动态焦点:一亩地可以种多少玉米? 一亩种植玉米的数量一亩种植玉米的数量需要根据玉米的品种来规划,杂交平展型玉米株型高大、叶片较宽所以每亩种3000-3500株,而杂交树叶型玉米

动态焦点:一亩地可以种多少玉米? 一亩种植玉米的数量一亩种植玉米的数量需要根据玉米的品种来规划,杂交平展型玉米株型高大、叶片较宽所以每亩种3000-3500株,而杂交树叶型玉米 -

我国首款双源智能重卡成功下线,用于公路和矿山运输

IT之家3月14日消息,据央视新闻报道,由中国中车研发的我国首款双源智能重卡在山西大同成功下线,这是我国重卡汽车在公路及矿山系统实现...

我国首款双源智能重卡成功下线,用于公路和矿山运输

IT之家3月14日消息,据央视新闻报道,由中国中车研发的我国首款双源智能重卡在山西大同成功下线,这是我国重卡汽车在公路及矿山系统实现... -

世界热门:【远见-两会财经热点观察】“除”焦虑,让年轻人积极乐观向未来 本期话题:经济之声《远见-两会财经热点观察》,以“加”“减”“乘”“除”为关键字,聚焦经济民生热点话题。当下年轻人的焦虑情绪是否...

世界热门:【远见-两会财经热点观察】“除”焦虑,让年轻人积极乐观向未来 本期话题:经济之声《远见-两会财经热点观察》,以“加”“减”“乘”“除”为关键字,聚焦经济民生热点话题。当下年轻人的焦虑情绪是否... -

每日资讯:《荒野行动》宣布联动《假面骑士》,3 月 15 日开启

IT之家3月14日消息,《荒野行动》官方宣布联动《假面骑士》,3月15日开启,截至3月30日。IT之家从海报中获取到,本次联动的人物或许包

每日资讯:《荒野行动》宣布联动《假面骑士》,3 月 15 日开启

IT之家3月14日消息,《荒野行动》官方宣布联动《假面骑士》,3月15日开启,截至3月30日。IT之家从海报中获取到,本次联动的人物或许包 -

环球速读:常见可以年年采摘的蔬菜有哪些? 常见的可以年年采摘的蔬菜茼蒿:茼蒿是一种富含营养的叶菜类蔬菜,具有甜美的口感和独特的香味,适合在春季和秋季种植。茼蒿具有很强的...

环球速读:常见可以年年采摘的蔬菜有哪些? 常见的可以年年采摘的蔬菜茼蒿:茼蒿是一种富含营养的叶菜类蔬菜,具有甜美的口感和独特的香味,适合在春季和秋季种植。茼蒿具有很强的... -

全球观焦点:人参果几年挂果?种植人参果的条件? 影响人参果挂果期的因素人参果的挂果期与其品种和生态环境有关,它的生长环境要求较高,如气温、土壤、湿度等都要在一定范围内才能促进...

全球观焦点:人参果几年挂果?种植人参果的条件? 影响人参果挂果期的因素人参果的挂果期与其品种和生态环境有关,它的生长环境要求较高,如气温、土壤、湿度等都要在一定范围内才能促进... -

【全球速看料】冰草是怎么种植的? 冰草的繁殖通过分株和种子两种方式繁殖。如果使用种子进行繁殖,可以选择优质的种子,尽量避免使用老化的种子,以确保发芽率。先将冰草...

【全球速看料】冰草是怎么种植的? 冰草的繁殖通过分株和种子两种方式繁殖。如果使用种子进行繁殖,可以选择优质的种子,尽量避免使用老化的种子,以确保发芽率。先将冰草... -

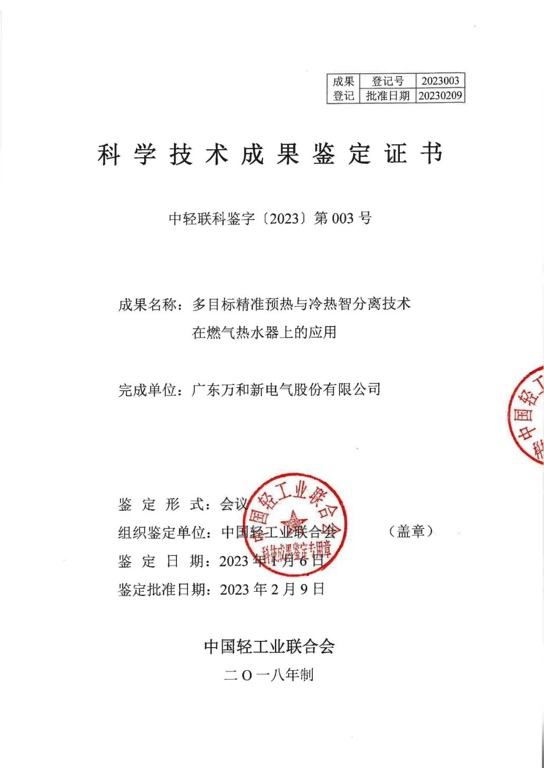

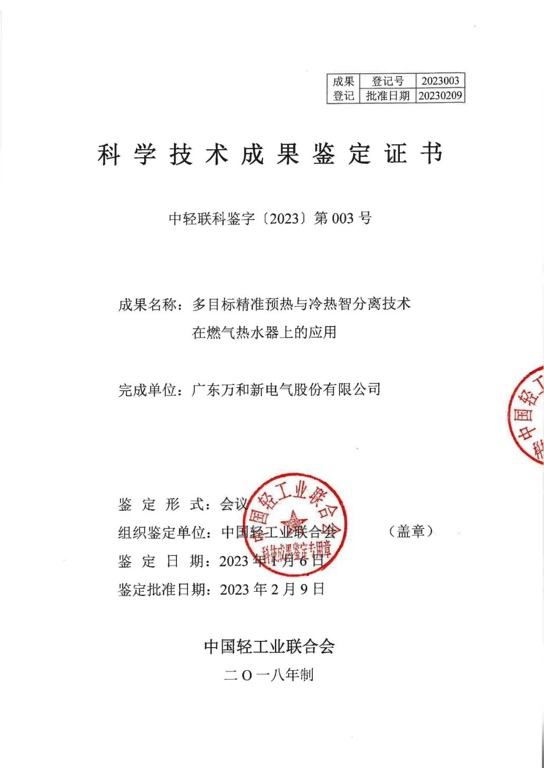

厨卫电器专家万和燃气热水器技术项目荣获国际领先成果鉴定! 近日,中国轻工业联合会在佛山以线上线下相结合的形式组织并主持召开了由广东万和新电气股份有限公司研发的多目标精准预热技术与冷热智分离

厨卫电器专家万和燃气热水器技术项目荣获国际领先成果鉴定! 近日,中国轻工业联合会在佛山以线上线下相结合的形式组织并主持召开了由广东万和新电气股份有限公司研发的多目标精准预热技术与冷热智分离 -

共享充电宝充电太慢遭吐槽,测试发现半小时才充 20%

IT之家3月14日消息,共享充电宝经常被调侃为“钱包刺客”,主要是由于其存在价格飞涨、充电太慢、好借难还等诸多槽点。IT之家从杭州市消...

共享充电宝充电太慢遭吐槽,测试发现半小时才充 20%

IT之家3月14日消息,共享充电宝经常被调侃为“钱包刺客”,主要是由于其存在价格飞涨、充电太慢、好借难还等诸多槽点。IT之家从杭州市消...

热门资讯

-

厨卫电器专家万和燃气热水器技术项目荣获国际领先成果鉴定! 近日,中国轻工业联合会在佛山以线...

厨卫电器专家万和燃气热水器技术项目荣获国际领先成果鉴定! 近日,中国轻工业联合会在佛山以线... -

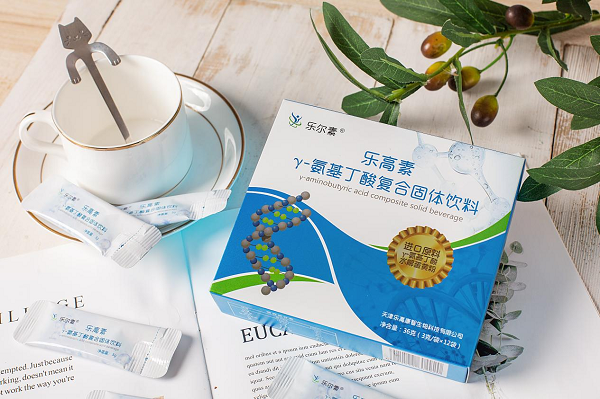

富含儿童成长核心元素,乐高素(乐尔素)γ-氨基丁酸复合饮料为成长助力 根据中国卫生部首次发布的《中国0...

富含儿童成长核心元素,乐高素(乐尔素)γ-氨基丁酸复合饮料为成长助力 根据中国卫生部首次发布的《中国0... -

携手22席品牌,抖音38好物节「她有引力」战报来了! 在刚刚过去的三八妇女节,抖音电商...

携手22席品牌,抖音38好物节「她有引力」战报来了! 在刚刚过去的三八妇女节,抖音电商... -

春游好时节,临沂市郯城唯一一个外出春游遛娃的最佳场所:郯城囧小蜂森林乐园! 春季到来,万物复苏,天气凉爽,是...

春游好时节,临沂市郯城唯一一个外出春游遛娃的最佳场所:郯城囧小蜂森林乐园! 春季到来,万物复苏,天气凉爽,是...

观察

图片新闻

-

世界今日报丨中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉...

世界今日报丨中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉... -

硅谷银行破产,美国市场很慌 美国硅谷银行破产事件仍在持续发酵...

硅谷银行破产,美国市场很慌 美国硅谷银行破产事件仍在持续发酵... -

BBC纪录片还原20年前重大失误:英美靠乌龙情报发动伊拉克战争 20年前,在美国以一管成分不明的白...

BBC纪录片还原20年前重大失误:英美靠乌龙情报发动伊拉克战争 20年前,在美国以一管成分不明的白... -

【焦点热闻】FBI:美国仇恨犯罪一年激增近12% 少数族裔频受攻击 据美国全国广播公司报道,美国联邦...

【焦点热闻】FBI:美国仇恨犯罪一年激增近12% 少数族裔频受攻击 据美国全国广播公司报道,美国联邦...

精彩新闻

-

全球速递!LG gram style 轻薄本上架:搭载 OLED 屏 + 隐藏式触控板

IT之家3月14日消息,LG在今年1月份...

全球速递!LG gram style 轻薄本上架:搭载 OLED 屏 + 隐藏式触控板

IT之家3月14日消息,LG在今年1月份... -

ROG 幻 16 翻转版 15 日开售,13代酷睿 i9 处理器+RTX40 系显卡

一直以来,ROG的幻系列都是开拓笔...

ROG 幻 16 翻转版 15 日开售,13代酷睿 i9 处理器+RTX40 系显卡

一直以来,ROG的幻系列都是开拓笔... -

飞利浦 EVNIA 8900 显示器今晚开卖:4K 138Hz高刷屏,到手8999元

IT之家3月14日消息,飞利浦EVNIA89...

飞利浦 EVNIA 8900 显示器今晚开卖:4K 138Hz高刷屏,到手8999元

IT之家3月14日消息,飞利浦EVNIA89... -

英伟达 RTX 3050 64bit 显存版性能曝光:i5-12500H 核显的两倍

IT之家3月14日消息,雷神昨日推出...

英伟达 RTX 3050 64bit 显存版性能曝光:i5-12500H 核显的两倍

IT之家3月14日消息,雷神昨日推出... -

富含儿童成长核心元素,乐高素(乐尔素)γ-氨基丁酸复合饮料为成长助力 根据中国卫生部首次发布的《中国0...

富含儿童成长核心元素,乐高素(乐尔素)γ-氨基丁酸复合饮料为成长助力 根据中国卫生部首次发布的《中国0... -

天天微动态丨滁州琅琊区:服务业赋能区域经济高质量发展 2022年以来,琅琊区加快实施服务业...

天天微动态丨滁州琅琊区:服务业赋能区域经济高质量发展 2022年以来,琅琊区加快实施服务业... -

大众将其五年支出计划提高到 1800 亿欧元,发力电动汽车和软件

IT之家3月14日消息,大众汽车在周...

大众将其五年支出计划提高到 1800 亿欧元,发力电动汽车和软件

IT之家3月14日消息,大众汽车在周... -

携手22席品牌,抖音38好物节「她有引力」战报来了! 在刚刚过去的三八妇女节,抖音电商...

携手22席品牌,抖音38好物节「她有引力」战报来了! 在刚刚过去的三八妇女节,抖音电商... -

BBC纪录片还原20年前重大失误:英美靠乌龙情报发动伊拉克战争 20年前,在美国以一管成分不明的白...

BBC纪录片还原20年前重大失误:英美靠乌龙情报发动伊拉克战争 20年前,在美国以一管成分不明的白... -

每日观点:索尼拿《星空》质疑微软收购暴雪后不搞独占:收购B社前也这么说

IT之家3月14日消息,索尼公司近日...

每日观点:索尼拿《星空》质疑微软收购暴雪后不搞独占:收购B社前也这么说

IT之家3月14日消息,索尼公司近日... -

看热讯:杭州发布户籍制度改革征求意见:拟全面放开县域落户政策 3月13日,杭州市政府网站发布《关...

看热讯:杭州发布户籍制度改革征求意见:拟全面放开县域落户政策 3月13日,杭州市政府网站发布《关... -

世界今日报丨中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉...

世界今日报丨中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉... -

抖音企业店铺要交税吗?开店有前景吗? 现如今只要说起抖音小店相信都不...

抖音企业店铺要交税吗?开店有前景吗? 现如今只要说起抖音小店相信都不... -

硅谷银行破产,美国市场很慌 美国硅谷银行破产事件仍在持续发酵...

硅谷银行破产,美国市场很慌 美国硅谷银行破产事件仍在持续发酵... -

速递!快手一万粉丝怎样带货?快手带货有方法吗? 快手用户想要直播带货,首先要有粉...

速递!快手一万粉丝怎样带货?快手带货有方法吗? 快手用户想要直播带货,首先要有粉... -

每日快报!新县烟草专卖局:植下新绿 扮靓乡村 春风催新绿,植树正当时。3月10日...

每日快报!新县烟草专卖局:植下新绿 扮靓乡村 春风催新绿,植树正当时。3月10日... -

每日热议!红细胞体积分布宽度偏低是什么原因造成的_红细胞体积分布宽度偏低 1、红细胞分布宽度偏低的原因?37...

每日热议!红细胞体积分布宽度偏低是什么原因造成的_红细胞体积分布宽度偏低 1、红细胞分布宽度偏低的原因?37... -

当前视讯!北京疾控发布防流感消毒指南,家庭和学校要勤开窗勤通风 北京市疾控中心发布集体单位及家庭...

当前视讯!北京疾控发布防流感消毒指南,家庭和学校要勤开窗勤通风 北京市疾控中心发布集体单位及家庭... -

环球视点!抖音抢的抖币会过期吗?抖币能换现金吗? 抖币是抖音平台上的一种虚拟货币,...

环球视点!抖音抢的抖币会过期吗?抖币能换现金吗? 抖币是抖音平台上的一种虚拟货币,... -

【焦点热闻】FBI:美国仇恨犯罪一年激增近12% 少数族裔频受攻击 据美国全国广播公司报道,美国联邦...

【焦点热闻】FBI:美国仇恨犯罪一年激增近12% 少数族裔频受攻击 据美国全国广播公司报道,美国联邦... -

【当前热闻】realme 10T 5G 手机官宣3 月 21 日发布,搭载天玑 810 处理器

IT之家3月14日消息,realme目前在...

【当前热闻】realme 10T 5G 手机官宣3 月 21 日发布,搭载天玑 810 处理器

IT之家3月14日消息,realme目前在... -

焦点简讯:全球连线|中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉...

焦点简讯:全球连线|中国医生“点亮”吉布提白内障患者希望之光 近日,“消除白内障致盲项目”在吉... -

联合创新推出 27G1S 显示器:QHD 240Hz,首发 1499 元

IT之家3月14日消息,联合创新今日...

联合创新推出 27G1S 显示器:QHD 240Hz,首发 1499 元

IT之家3月14日消息,联合创新今日... -

环球最新:昂达推出新款 B450S-W 主板:支持锐龙 1-5 代,429 元

IT之家3月14日消息,昂达现已推出...

环球最新:昂达推出新款 B450S-W 主板:支持锐龙 1-5 代,429 元

IT之家3月14日消息,昂达现已推出... -

春游好时节,临沂市郯城唯一一个外出春游遛娃的最佳场所:郯城囧小蜂森林乐园! 春季到来,万物复苏,天气凉爽,是...

春游好时节,临沂市郯城唯一一个外出春游遛娃的最佳场所:郯城囧小蜂森林乐园! 春季到来,万物复苏,天气凉爽,是... -

美15岁少年光天化日下遭枪杀:身中10枪 或有3名枪手 据美国福克斯新闻网报道,当地时间...

美15岁少年光天化日下遭枪杀:身中10枪 或有3名枪手 据美国福克斯新闻网报道,当地时间... -

环球百事通!怎样提高抖音店铺评分?有哪些技巧? 抖音现在是可以开店的,大家开店...

环球百事通!怎样提高抖音店铺评分?有哪些技巧? 抖音现在是可以开店的,大家开店... -

天王表手表是名牌吗 天王表和浪琴是一个档次的吗? 旧手表是什么垃圾旧手表属于可回收...

天王表手表是名牌吗 天王表和浪琴是一个档次的吗? 旧手表是什么垃圾旧手表属于可回收... -

烤地瓜哪里的名吃 烤地瓜跟烤红薯一样吗? 烤地瓜是哪里的特产山东烤地瓜全国...

烤地瓜哪里的名吃 烤地瓜跟烤红薯一样吗? 烤地瓜是哪里的特产山东烤地瓜全国... -

梧州是几线城市 梧州在广西算富裕吗? 梧州是几线城市梧州是四线城市。梧...

-

小型电烤箱怎么烤蛋挞 烤蛋挞180度还是200度? 烤蛋挞需要烤多长时间蛋挞要烤15-2...

小型电烤箱怎么烤蛋挞 烤蛋挞180度还是200度? 烤蛋挞需要烤多长时间蛋挞要烤15-2... -

重庆西站是火车站还是高铁站 重庆站离解放碑有多远? 重庆西站是火车站还是高铁站重庆西...

-

「送你一座花园」,大宁国际春日限定浪漫! 缤纷三月,爱意渐浓,礼物和情书都...

「送你一座花园」,大宁国际春日限定浪漫! 缤纷三月,爱意渐浓,礼物和情书都... -

水浒传主要内容是什么 水浒传让我们明白了什么道理? 水浒传主要内容是什么水浒传主要内...

水浒传主要内容是什么 水浒传让我们明白了什么道理? 水浒传主要内容是什么水浒传主要内... -

84消毒液对人体有害吗 室内消毒的正确方法是什么? 84消毒液对人体有害吗如果84消毒液...

84消毒液对人体有害吗 室内消毒的正确方法是什么? 84消毒液对人体有害吗如果84消毒液... -

瑞丽是哪个省的城市 瑞丽市十大旅游景点 瑞丽是哪个省的城市瑞丽是云南省的...

瑞丽是哪个省的城市 瑞丽市十大旅游景点 瑞丽是哪个省的城市瑞丽是云南省的... -

椰子肉怎么吃 新鲜椰子肉最佳吃法 椰子肉可以做什么甜品? 将椰子肉取出来,在榨汁机里面加入...

椰子肉怎么吃 新鲜椰子肉最佳吃法 椰子肉可以做什么甜品? 将椰子肉取出来,在榨汁机里面加入... -

我们变了,也没变——中国力量稳稳向前! 从春天出发,向未来起航全国两会胜...

我们变了,也没变——中国力量稳稳向前! 从春天出发,向未来起航全国两会胜... -

曹文轩是什么作家 曹文轩的作品有什么 ? 曹文轩是什么作家曹文轩是中国儿童...

曹文轩是什么作家 曹文轩的作品有什么 ? 曹文轩是什么作家曹文轩是中国儿童... -

悉尼是哪个国家的首都 悉尼是一个怎样的国家? 悉尼是哪个国家的首都?1、澳大利亚...

悉尼是哪个国家的首都 悉尼是一个怎样的国家? 悉尼是哪个国家的首都?1、澳大利亚... -

皮丘的佩戴方法黄金 金皮丘貔貅手链戴哪只手? 皮丘的佩戴方法黄金1、皮丘佩戴手...

皮丘的佩戴方法黄金 金皮丘貔貅手链戴哪只手? 皮丘的佩戴方法黄金1、皮丘佩戴手... -

成龙张学友谢霆锋张家辉同框 张学友和成龙关系好吗? 成龙张学友谢霆锋张家辉同框2023英...

成龙张学友谢霆锋张家辉同框 张学友和成龙关系好吗? 成龙张学友谢霆锋张家辉同框2023英... -

最佳睡眠时间是什么时候 12点睡7点起算熬夜吗? 最佳睡眠时间是什么时候1、一般来...

最佳睡眠时间是什么时候 12点睡7点起算熬夜吗? 最佳睡眠时间是什么时候1、一般来... -

什么属相的人养不活绿植 买的绿植为什么养不活? 什么属相的人养不活绿植1、生肖牛...

什么属相的人养不活绿植 买的绿植为什么养不活? 什么属相的人养不活绿植1、生肖牛... -

11家!全面注册制下首批主板IPO过会,均为平移企业 沪市首批5家主板、深市首批6家平移...

11家!全面注册制下首批主板IPO过会,均为平移企业 沪市首批5家主板、深市首批6家平移... -

龙须草适合什么属相的人养 家里可以养龙须草吗? 龙须草适合什么属相的人养1、龙须...

龙须草适合什么属相的人养 家里可以养龙须草吗? 龙须草适合什么属相的人养1、龙须... -

简讯:ROG 新款幻 16 翻转版笔记本今晚开卖,13499 元起

IT之家3月14日消息,ROG新款幻16翻...

简讯:ROG 新款幻 16 翻转版笔记本今晚开卖,13499 元起

IT之家3月14日消息,ROG新款幻16翻... -

千锋教育成为百度文心一言首批生态合作伙伴 近日,千锋教育宣布成为百度文心一...

千锋教育成为百度文心一言首批生态合作伙伴 近日,千锋教育宣布成为百度文心一... -

什么属相的人养兔子好 属兔人养什么动物最旺财? 什么属相的人养兔子好1、属牛的人...

什么属相的人养兔子好 属兔人养什么动物最旺财? 什么属相的人养兔子好1、属牛的人... -

梁朝伟刘德华二十年后再合作 梁朝伟刘德华关系好吗? 梁朝伟刘德华二十年后再合作话题梁...

梁朝伟刘德华二十年后再合作 梁朝伟刘德华关系好吗? 梁朝伟刘德华二十年后再合作话题梁...