【世界报资讯】英伟达 Hopper 架构 H100 GPU 全面投产

来源:搜狐号-IT之家 时间:2022-09-21 21:59:40

(资料图片)

(资料图片)

IT之家 9 月 21 日消息,据英伟达官方消息,英伟达于今日宣布 NVIDIA H100 Tensor Core GPU 全面投产,NVIDIA 全球技术合作伙伴计划于 10 月推出首批基于开创性 NVIDIA Hopper 架构的产品和服务。

IT之家了解到,H100 于 2022 年 4 月发布,由 800 亿个晶体管组成,并采用了众多开创性的技术,包括强大的全新 Transformer 引擎和 NVIDIA NVLink 互连技术,以加速最大规模的 AI 模型,如高级推荐系统和大型语言模型,并推动对话式 AI 和药物发现等领域的创新。

英伟达表示,H100 使企业能够削减 AI 的部署成本,相较于上一代,在提供相同 AI 性能的情况下,可将能效提高 3.5 倍,总体拥有成本减少至 1/3,所使用的服务器节点数也减少至 1/5。

NVIDIA DGX H100 系统现在也已开始接受客户预定。该系统包含 8 个 H100 GPU,FP8 精度的峰值性能达到 32 PFlops。每个 DGX 系统都包含 NVIDIA Base Command 和 NVIDIA AI Enterprise 软件,可实现从单一节点到 NVIDIA DGX SuperPOD 的集群部署,为大型语言模型和其他大规模工作负载的高级 AI 开发工作提供支持。

全球领先的计算机制造商所提供的搭载 H100 的系统预计将在未来几周内发货,到今年年底将有超过 50 款服务器型号面市,2023 年上半年还将有数十款型号面市。已在构建系统的合作伙伴包括源讯(Atos)、思科、戴尔科技、富士通、技嘉科技、慧与、联想和超微。

-

【世界报资讯】英伟达 Hopper 架构 H100 GPU 全面投产

IT之家9月21日消息,据英伟达官方消息,英伟达于今日宣布NVIDIAH100TensorCoreGPU全面投产,NVIDIA全球技术合作

【世界报资讯】英伟达 Hopper 架构 H100 GPU 全面投产

IT之家9月21日消息,据英伟达官方消息,英伟达于今日宣布NVIDIAH100TensorCoreGPU全面投产,NVIDIA全球技术合作 -

每日消息!“我真的是栓Q”,小学生把网络语写进作文,老师看后血压飙升

如今网络上充斥着各种网络用语,而随着青少年普遍接触网络并日益成为网络使用的主力,对网络语言的传播使用愈来频繁,但网络用语存在良...

每日消息!“我真的是栓Q”,小学生把网络语写进作文,老师看后血压飙升

如今网络上充斥着各种网络用语,而随着青少年普遍接触网络并日益成为网络使用的主力,对网络语言的传播使用愈来频繁,但网络用语存在良... -

世界速递!担忧法律风险,拼多多海外版Temu暂不会上线 “砍一刀” 功能

据晚点LatePost报道,拼多多Temu在海外暂不会上线“砍一刀”功能,团队在移动端或将采取内容社区的形式来提高交易转化率。另外,9月Temu的

世界速递!担忧法律风险,拼多多海外版Temu暂不会上线 “砍一刀” 功能

据晚点LatePost报道,拼多多Temu在海外暂不会上线“砍一刀”功能,团队在移动端或将采取内容社区的形式来提高交易转化率。另外,9月Temu的 -

焦点快报!阿里近 3 个月减持 603 万股快狗打车,约 4969 万港元

IT之家9月21日消息,港交所最新资料显示,阿里巴巴9月15日减持快狗打车(02246 HK)23 24万股,减持后最新持股数目约为86

焦点快报!阿里近 3 个月减持 603 万股快狗打车,约 4969 万港元

IT之家9月21日消息,港交所最新资料显示,阿里巴巴9月15日减持快狗打车(02246 HK)23 24万股,减持后最新持股数目约为86 -

全球热门:《英雄联盟》“全球总决赛版本”更新,“毒菇梦魇”系列皮肤加入

IT之家9月21日消息,《英雄联盟》将在9月22日凌晨1点开始全区停机维护,发布12 18版本。据介绍,这将是2022全球总决赛版

全球热门:《英雄联盟》“全球总决赛版本”更新,“毒菇梦魇”系列皮肤加入

IT之家9月21日消息,《英雄联盟》将在9月22日凌晨1点开始全区停机维护,发布12 18版本。据介绍,这将是2022全球总决赛版 -

每日简讯:微软:未来一年将继续扩大中国招聘,员工总数预计突破 1 万人

IT之家9月21日消息,从微软获悉,随着迎来落户中国三十周年,微软宣布在继续践行对中国市场长期承诺的同时,将围绕人才吸纳、园区扩建、...

每日简讯:微软:未来一年将继续扩大中国招聘,员工总数预计突破 1 万人

IT之家9月21日消息,从微软获悉,随着迎来落户中国三十周年,微软宣布在继续践行对中国市场长期承诺的同时,将围绕人才吸纳、园区扩建、...

-

【世界报资讯】英伟达 Hopper 架构 H100 GPU 全面投产

IT之家9月21日消息,据英伟达官方消息,英伟达于今日宣布NVIDIAH100TensorCoreGPU全面投产,NVIDIA全球技术合作

【世界报资讯】英伟达 Hopper 架构 H100 GPU 全面投产

IT之家9月21日消息,据英伟达官方消息,英伟达于今日宣布NVIDIAH100TensorCoreGPU全面投产,NVIDIA全球技术合作 -

每日消息!“我真的是栓Q”,小学生把网络语写进作文,老师看后血压飙升

如今网络上充斥着各种网络用语,而随着青少年普遍接触网络并日益成为网络使用的主力,对网络语言的传播使用愈来频繁,但网络用语存在良...

每日消息!“我真的是栓Q”,小学生把网络语写进作文,老师看后血压飙升

如今网络上充斥着各种网络用语,而随着青少年普遍接触网络并日益成为网络使用的主力,对网络语言的传播使用愈来频繁,但网络用语存在良... -

世界速递!担忧法律风险,拼多多海外版Temu暂不会上线 “砍一刀” 功能

据晚点LatePost报道,拼多多Temu在海外暂不会上线“砍一刀”功能,团队在移动端或将采取内容社区的形式来提高交易转化率。另外,9月Temu的

世界速递!担忧法律风险,拼多多海外版Temu暂不会上线 “砍一刀” 功能

据晚点LatePost报道,拼多多Temu在海外暂不会上线“砍一刀”功能,团队在移动端或将采取内容社区的形式来提高交易转化率。另外,9月Temu的 -

热资讯!过年送黑枸杞合适吗 过年送黑枸杞好吗 1、过年送黑枸杞合适,黑枸杞,富含蛋白质、枸杞多糖、氨基酸、维生素、矿物质、微量元素等多种营养成分。2、还富含特有的天然原花青素...

热资讯!过年送黑枸杞合适吗 过年送黑枸杞好吗 1、过年送黑枸杞合适,黑枸杞,富含蛋白质、枸杞多糖、氨基酸、维生素、矿物质、微量元素等多种营养成分。2、还富含特有的天然原花青素... -

中海长租公寓推出Glamping2.0活动,让温暖成为生活的底色 每当支起一顶帐篷,便有一群相互吸引的灵魂在欢聚。无论是喜爱瑜伽的运动女孩,或是亲近自然的插画师……每一种理想生活的模样、每一段...

中海长租公寓推出Glamping2.0活动,让温暖成为生活的底色 每当支起一顶帐篷,便有一群相互吸引的灵魂在欢聚。无论是喜爱瑜伽的运动女孩,或是亲近自然的插画师……每一种理想生活的模样、每一段... -

天天观热点:绿豆种子发芽前要泡几天 绿豆种子发芽前要泡多久 1、绿豆一般情况下要泡3-6天才能发芽。2、但是要注意水分、温度等等,豆子发胀了在芽眼会有一点白色的根露出就可以种了,泡的时间也不能...

天天观热点:绿豆种子发芽前要泡几天 绿豆种子发芽前要泡多久 1、绿豆一般情况下要泡3-6天才能发芽。2、但是要注意水分、温度等等,豆子发胀了在芽眼会有一点白色的根露出就可以种了,泡的时间也不能... -

资讯推荐:甘蔗种子要泡几天发芽 甘蔗种子要泡多久发芽 1、甘蔗在春季时进行播种,因为温度较为适宜,发芽期只需要15-20天。2、想要甘蔗快速发芽的话,可以选择用石灰水来浸泡甘蔗种苗。把甘蔗种苗放入

资讯推荐:甘蔗种子要泡几天发芽 甘蔗种子要泡多久发芽 1、甘蔗在春季时进行播种,因为温度较为适宜,发芽期只需要15-20天。2、想要甘蔗快速发芽的话,可以选择用石灰水来浸泡甘蔗种苗。把甘蔗种苗放入 -

新动态:大枣种子泡几天能发芽 大枣种子泡多久能发芽 1、红枣种子,如果操作正确的情况下,一周就可以发芽;2、具体的培育过程如下:(1)首先要在一堆品质比较好的红枣中仔细的挑选有枣核的...

新动态:大枣种子泡几天能发芽 大枣种子泡多久能发芽 1、红枣种子,如果操作正确的情况下,一周就可以发芽;2、具体的培育过程如下:(1)首先要在一堆品质比较好的红枣中仔细的挑选有枣核的... -

焦点快报!阿里近 3 个月减持 603 万股快狗打车,约 4969 万港元

IT之家9月21日消息,港交所最新资料显示,阿里巴巴9月15日减持快狗打车(02246 HK)23 24万股,减持后最新持股数目约为86

焦点快报!阿里近 3 个月减持 603 万股快狗打车,约 4969 万港元

IT之家9月21日消息,港交所最新资料显示,阿里巴巴9月15日减持快狗打车(02246 HK)23 24万股,减持后最新持股数目约为86 -

报道:金科·博翠碧蓝湾丨匠心交付,探寻美好背后的细节 回家的路,是世间最暖的归途。金科·博翠碧蓝湾历经无数个日夜的精工细作,让曾经方寸之间的图纸,变作如今温暖的家,当前来验房的业主...

报道:金科·博翠碧蓝湾丨匠心交付,探寻美好背后的细节 回家的路,是世间最暖的归途。金科·博翠碧蓝湾历经无数个日夜的精工细作,让曾经方寸之间的图纸,变作如今温暖的家,当前来验房的业主... -

天天微动态丨共鉴美好,心悦归家丨昆明集美玉溪星台品质交付 从一纸蓝图,到品质交付,从造梦生活,到美好呈现。6月25日,昆明金科·集美玉溪星台1 、2 、3 、4 、5 、6 、7 、8 高层迎来了...

天天微动态丨共鉴美好,心悦归家丨昆明集美玉溪星台品质交付 从一纸蓝图,到品质交付,从造梦生活,到美好呈现。6月25日,昆明金科·集美玉溪星台1 、2 、3 、4 、5 、6 、7 、8 高层迎来了... -

环球简讯:撒花~青浦环城水系公园被这2项国际设计大奖“相中”啦~ 青浦环城水系公园是青浦区有史以来最大的民生工程之一,以独具匠心的设计勾勒出一条美丽的水城“金腰带”,自全线贯通以来备受广大市民...

环球简讯:撒花~青浦环城水系公园被这2项国际设计大奖“相中”啦~ 青浦环城水系公园是青浦区有史以来最大的民生工程之一,以独具匠心的设计勾勒出一条美丽的水城“金腰带”,自全线贯通以来备受广大市民... -

天天资讯:江苏中行全力支持第五届进博会线上招商路演(江苏省专场)活动 9月21日,中国国际进口博览局、国家会展中心(上海)、江苏省商务厅共同主办第五届中国国际进口博览会线上招商路演(江苏省专场)活动,...

天天资讯:江苏中行全力支持第五届进博会线上招商路演(江苏省专场)活动 9月21日,中国国际进口博览局、国家会展中心(上海)、江苏省商务厅共同主办第五届中国国际进口博览会线上招商路演(江苏省专场)活动,... -

【全球快播报】龙井茶泡茶方法 龙井茶泡茶方法是什么 1、茶具选择。冲泡龙井茶,使用白瓷盖碗最佳。白瓷盖碗口径大,方便注水,散热快;白瓷盖碗釉质紧密,可充分发挥出龙井茶香茶味;精致的白...

【全球快播报】龙井茶泡茶方法 龙井茶泡茶方法是什么 1、茶具选择。冲泡龙井茶,使用白瓷盖碗最佳。白瓷盖碗口径大,方便注水,散热快;白瓷盖碗釉质紧密,可充分发挥出龙井茶香茶味;精致的白... -

全球热门:《英雄联盟》“全球总决赛版本”更新,“毒菇梦魇”系列皮肤加入

IT之家9月21日消息,《英雄联盟》将在9月22日凌晨1点开始全区停机维护,发布12 18版本。据介绍,这将是2022全球总决赛版

全球热门:《英雄联盟》“全球总决赛版本”更新,“毒菇梦魇”系列皮肤加入

IT之家9月21日消息,《英雄联盟》将在9月22日凌晨1点开始全区停机维护,发布12 18版本。据介绍,这将是2022全球总决赛版 -

全球观天下!太湖翠竹怎么泡 太湖翠竹如何泡 1、温杯。冲泡太湖翠竹茶用纯净水为宜,倒入杯中,先让杯子升温,这样冲泡茶叶的时候能使茶叶散发出独特的香味,这是第一步。2、取茶。...

全球观天下!太湖翠竹怎么泡 太湖翠竹如何泡 1、温杯。冲泡太湖翠竹茶用纯净水为宜,倒入杯中,先让杯子升温,这样冲泡茶叶的时候能使茶叶散发出独特的香味,这是第一步。2、取茶。... -

天天报道:水杯fga能装热水吗 水杯fga能不能装热水 1、水杯fga能装热水,它的材料是食品级PC塑料。PC是聚碳酸酯的简称,PC具有优异的电绝缘性、延伸性、尺寸稳定性、耐化学腐蚀性、耐热性和耐寒

天天报道:水杯fga能装热水吗 水杯fga能不能装热水 1、水杯fga能装热水,它的材料是食品级PC塑料。PC是聚碳酸酯的简称,PC具有优异的电绝缘性、延伸性、尺寸稳定性、耐化学腐蚀性、耐热性和耐寒 -

世界热门:面向Web3.0的Conflux OS操作系统在沪发布 在9月20日举办的“奋进新征程建功新时代”党委专题系列新闻发布会第二场——科技创新专场发布会上,上海市科学技术工作党委书记徐枫表示...

世界热门:面向Web3.0的Conflux OS操作系统在沪发布 在9月20日举办的“奋进新征程建功新时代”党委专题系列新闻发布会第二场——科技创新专场发布会上,上海市科学技术工作党委书记徐枫表示... -

【独家】男士潇洒霸气网名 霸气个性潇洒男生网名推荐 1、ㄟ熊猫先生2、遗梦少年3、盲男!4、誰與我狂5、柔情痞子6、真材实料的我7、哥不是高富帅丶8、-被判无妻徒刑、9、°青春期10、2B少年无烦恼1

【独家】男士潇洒霸气网名 霸气个性潇洒男生网名推荐 1、ㄟ熊猫先生2、遗梦少年3、盲男!4、誰與我狂5、柔情痞子6、真材实料的我7、哥不是高富帅丶8、-被判无妻徒刑、9、°青春期10、2B少年无烦恼1 -

每日消息!在家制作甜品方法 在家如何制作甜品 1、海蓝糯米小方,食材:糯米粉120克、玉米淀粉30克、牛奶165克、糖30克、蝶豆花3克、玉米油10克、椰蓉适量。做法:牛奶加蝶豆花浸泡出蓝色。

每日消息!在家制作甜品方法 在家如何制作甜品 1、海蓝糯米小方,食材:糯米粉120克、玉米淀粉30克、牛奶165克、糖30克、蝶豆花3克、玉米油10克、椰蓉适量。做法:牛奶加蝶豆花浸泡出蓝色。 -

每日简讯:微软:未来一年将继续扩大中国招聘,员工总数预计突破 1 万人

IT之家9月21日消息,从微软获悉,随着迎来落户中国三十周年,微软宣布在继续践行对中国市场长期承诺的同时,将围绕人才吸纳、园区扩建、...

每日简讯:微软:未来一年将继续扩大中国招聘,员工总数预计突破 1 万人

IT之家9月21日消息,从微软获悉,随着迎来落户中国三十周年,微软宣布在继续践行对中国市场长期承诺的同时,将围绕人才吸纳、园区扩建、... -

实时:教育部:全国劳动课不统一教材 避免一刀切 日前,教育部网站发布《对十三届全国人大五次会议第1224号建议的答复》。其中,在答复“关于将《劳动教育》教材纳入教科书目录”时,教...

实时:教育部:全国劳动课不统一教材 避免一刀切 日前,教育部网站发布《对十三届全国人大五次会议第1224号建议的答复》。其中,在答复“关于将《劳动教育》教材纳入教科书目录”时,教... -

焦点速看:壹号本公布全新飞行家OnexFly掌机:6 英寸屏,R5 7520U 处理器

IT之家9月21日消息,今天,壹号本公布全新系列飞行家OnexFly掌机,现招募内测玩家。IT之家获悉,该系列掌机将搭载6英寸屏,1080p分

焦点速看:壹号本公布全新飞行家OnexFly掌机:6 英寸屏,R5 7520U 处理器

IT之家9月21日消息,今天,壹号本公布全新系列飞行家OnexFly掌机,现招募内测玩家。IT之家获悉,该系列掌机将搭载6英寸屏,1080p分 -

热消息:“赶海父子”:视频偶然走红开启不一样的人生,回乡创业的大学生火了 编者按:沃野翻金浪,稻谷又飘香,又是一年丰收时。在连接特色农产品和全国消费者的纽带里,有这样一群扎根在家乡的“新农人”,他们通...

热消息:“赶海父子”:视频偶然走红开启不一样的人生,回乡创业的大学生火了 编者按:沃野翻金浪,稻谷又飘香,又是一年丰收时。在连接特色农产品和全国消费者的纽带里,有这样一群扎根在家乡的“新农人”,他们通... -

最新快讯!送给兵哥哥圣诞礼物送什么 送给兵哥哥圣诞礼物送什么比较好 1、送手表,像是星月菩提手表,白金戒,这几年也要送他喜欢的。不过现在这个手表还是很好的。如果是打算送,那就送钱包吧,皮带、钱包等...

最新快讯!送给兵哥哥圣诞礼物送什么 送给兵哥哥圣诞礼物送什么比较好 1、送手表,像是星月菩提手表,白金戒,这几年也要送他喜欢的。不过现在这个手表还是很好的。如果是打算送,那就送钱包吧,皮带、钱包等... -

每日简讯:肺部多次多发结节怎么办?上海多学科医疗团队一人一策让患者“不惧小节” “我已经切掉过5个结节了,医生说现在又长了1个,难道要把肺都切掉?我该怎么办……”患者许女士在上海市胸科医院(以下简称胸科医院)M...

每日简讯:肺部多次多发结节怎么办?上海多学科医疗团队一人一策让患者“不惧小节” “我已经切掉过5个结节了,医生说现在又长了1个,难道要把肺都切掉?我该怎么办……”患者许女士在上海市胸科医院(以下简称胸科医院)M... -

环球新动态:产教融合再深化 校企联手共建博洋产业学院 21日,在宁波市深化产教融合高峰论坛暨宁波都市圈高层次教育人才发展联盟成立仪式上,宁波市产教融合重大项目现场签约,浙江纺织服装职...

环球新动态:产教融合再深化 校企联手共建博洋产业学院 21日,在宁波市深化产教融合高峰论坛暨宁波都市圈高层次教育人才发展联盟成立仪式上,宁波市产教融合重大项目现场签约,浙江纺织服装职... -

天天即时看!2022世界制造业大会|总投资312.59亿元 铜陵铜加工产业向更高层次迈进 中国铜加工产业年度大会暨世界制造业大会中国(铜陵)铜产业高质量发展大会现场(央广网发铜陵市委宣传部供图)9月21日,中国铜加工产业...

天天即时看!2022世界制造业大会|总投资312.59亿元 铜陵铜加工产业向更高层次迈进 中国铜加工产业年度大会暨世界制造业大会中国(铜陵)铜产业高质量发展大会现场(央广网发铜陵市委宣传部供图)9月21日,中国铜加工产业... -

天天观速讯丨送女朋友什么礼物圣诞礼物 送女朋友哪些礼物圣诞礼物 1、口红:口红可以说是女孩子化妆的必备品了,在日常生活中即使不化全妆涂口红也能很好地提升气色,所以说口红可以说是非常好的送礼选择...

天天观速讯丨送女朋友什么礼物圣诞礼物 送女朋友哪些礼物圣诞礼物 1、口红:口红可以说是女孩子化妆的必备品了,在日常生活中即使不化全妆涂口红也能很好地提升气色,所以说口红可以说是非常好的送礼选择... -

世界新动态:川红茶的冲泡方法 川红茶如何冲泡 1、准备好茶叶和茶具。2、用茶荷欣赏川红干茶的色泽和外形。3、向碗中注入少量热水,用来温烫陶土碗,后弃入水盂。4、用茶匙将茶叶缓缓拨入碗

世界新动态:川红茶的冲泡方法 川红茶如何冲泡 1、准备好茶叶和茶具。2、用茶荷欣赏川红干茶的色泽和外形。3、向碗中注入少量热水,用来温烫陶土碗,后弃入水盂。4、用茶匙将茶叶缓缓拨入碗 -

当前短讯!茶叶水怎么洗脸好 茶叶水洗脸的方法 1、准备工作:先泡好一杯茶、准备几片化妆棉,洗净脸。2、操作过程:将茶水涂到脸上,并用手轻轻拍脸,或将蘸了茶水的脱脂棉附在脸上2-3...

当前短讯!茶叶水怎么洗脸好 茶叶水洗脸的方法 1、准备工作:先泡好一杯茶、准备几片化妆棉,洗净脸。2、操作过程:将茶水涂到脸上,并用手轻轻拍脸,或将蘸了茶水的脱脂棉附在脸上2-3... -

环球热点!家里水池如何清洗 家里水池怎么清洗 1、首先塞上水池的塞子,放水放至中等水位。2、在水中加入6~8滴洗涤剂,搅匀。3、等待,让洗涤剂浸泡水池约15分钟。然后使用毛巾将水池整个擦

环球热点!家里水池如何清洗 家里水池怎么清洗 1、首先塞上水池的塞子,放水放至中等水位。2、在水中加入6~8滴洗涤剂,搅匀。3、等待,让洗涤剂浸泡水池约15分钟。然后使用毛巾将水池整个擦 -

全球滚动:山西两煤矿发生人员死亡安全事故 已停产整顿 9月21日,记者从山西省应急管理厅了解到,9月20日,山西楼俊集团泰业煤业有限公司发生一起死亡1人的安全事故;9月19日,山西焦煤集团所属山西

全球滚动:山西两煤矿发生人员死亡安全事故 已停产整顿 9月21日,记者从山西省应急管理厅了解到,9月20日,山西楼俊集团泰业煤业有限公司发生一起死亡1人的安全事故;9月19日,山西焦煤集团所属山西 -

每日动态!联想 YOGA Pro 14s i9 版 9 月 26 日预售,配 32GB 大内存

IT之家9月21日消息,据联想官方消息,联想YOGAPro14si9版将在9月26日预售,售价暂未公布。据介绍,联想YOGAPro

每日动态!联想 YOGA Pro 14s i9 版 9 月 26 日预售,配 32GB 大内存

IT之家9月21日消息,据联想官方消息,联想YOGAPro14si9版将在9月26日预售,售价暂未公布。据介绍,联想YOGAPro -

热推荐:自然资源部:2021年我国新增石油探明地质储量超16亿吨 今天(9月21日),自然资源部发布《中国矿产资源报告(2022)》。报告显示,我国地质找矿不断取得突破,矿产资源家底进一步夯实,2021年,我国

热推荐:自然资源部:2021年我国新增石油探明地质储量超16亿吨 今天(9月21日),自然资源部发布《中国矿产资源报告(2022)》。报告显示,我国地质找矿不断取得突破,矿产资源家底进一步夯实,2021年,我国 -

【环球时快讯】钉钉总裁叶军:非常讨厌红点、从来不“DING”人

IT之家9月21日消息,今日,钉钉总裁叶军在数字化领军企业秋季钉峰会上分享了一些“趣闻”,称钉钉是消息非常多的产品,有很多红点,自己...

【环球时快讯】钉钉总裁叶军:非常讨厌红点、从来不“DING”人

IT之家9月21日消息,今日,钉钉总裁叶军在数字化领军企业秋季钉峰会上分享了一些“趣闻”,称钉钉是消息非常多的产品,有很多红点,自己... -

环球热讯:小米手环7推送1.27.0.4固件:新增电池管家,夜间模式迎来更新

IT之家9月21日消息,小米手环7现已推送全新固件更新,版本号1 27 0 4。更新内容显示,除修复若干Bug外,小米手环7在新版本中新增

环球热讯:小米手环7推送1.27.0.4固件:新增电池管家,夜间模式迎来更新

IT之家9月21日消息,小米手环7现已推送全新固件更新,版本号1 27 0 4。更新内容显示,除修复若干Bug外,小米手环7在新版本中新增 -

每日快播:上海警方捣毁非法放贷团伙 涉案金额达1.5亿 近日,上海长宁警方收到群众举报,称有人在网络上以公司名义开展非法放贷业务,多名被害人被电话骚扰、强制抵押等“软暴力”方式催收。...

每日快播:上海警方捣毁非法放贷团伙 涉案金额达1.5亿 近日,上海长宁警方收到群众举报,称有人在网络上以公司名义开展非法放贷业务,多名被害人被电话骚扰、强制抵押等“软暴力”方式催收。... -

每日观察!工信部:上半年平台北斗日均活跃用户达4030万 工信部消息,近年来,工信部着力推动北斗产业高质量发展,2022年上半年,平台北斗活跃用户量平均每日4030万,业务量每日3 2亿次。国内北斗高精

每日观察!工信部:上半年平台北斗日均活跃用户达4030万 工信部消息,近年来,工信部着力推动北斗产业高质量发展,2022年上半年,平台北斗活跃用户量平均每日4030万,业务量每日3 2亿次。国内北斗高精 -

刘畊宏、蒲熠星、童瑶打造惊天密逃团,好太太这场919直播“火了”! 9月19日,好太太的一场直播引来了全网围观,好太太品牌代言人童瑶、健身教练刘畊宏、密逃大神蒲熠星亮相发布会,共同打造最强惊天密逃团,一起

刘畊宏、蒲熠星、童瑶打造惊天密逃团,好太太这场919直播“火了”! 9月19日,好太太的一场直播引来了全网围观,好太太品牌代言人童瑶、健身教练刘畊宏、密逃大神蒲熠星亮相发布会,共同打造最强惊天密逃团,一起 -

速递!中央气象台:川渝滇桂秋雨绵绵 明起冷空气影响北方 中央气象台预计,本周,西南地区依旧秋雨绵绵,新一股冷空气将于明天起吹袭我国北方,东北地区将风雨交加、气温走低,需做好防雨保暖。...

速递!中央气象台:川渝滇桂秋雨绵绵 明起冷空气影响北方 中央气象台预计,本周,西南地区依旧秋雨绵绵,新一股冷空气将于明天起吹袭我国北方,东北地区将风雨交加、气温走低,需做好防雨保暖。... -

全球观天下!客厅里适合养什么花 客厅适合养殖的植物推荐 1、发财树。要说哪种花草因名字而大受欢迎、销量遥遥领先的,当属发财树了吧。最开始发财树也只不过是热带地区的一种最普通的乔木,只不...

全球观天下!客厅里适合养什么花 客厅适合养殖的植物推荐 1、发财树。要说哪种花草因名字而大受欢迎、销量遥遥领先的,当属发财树了吧。最开始发财树也只不过是热带地区的一种最普通的乔木,只不... -

当前资讯!衣柜的摆放方向禁忌 衣柜如何摆放 1、衣柜适宜摆放床左边:衣柜一般体型比较巨大,适合放在床的左边,能够聚集青龙位的吉气,但同时要记住,衣柜本身属性为阴,如果对着床...

当前资讯!衣柜的摆放方向禁忌 衣柜如何摆放 1、衣柜适宜摆放床左边:衣柜一般体型比较巨大,适合放在床的左边,能够聚集青龙位的吉气,但同时要记住,衣柜本身属性为阴,如果对着床... -

全球资讯:貔貅头方向摆放禁忌 貔貅头方向的摆放介绍 1、摆放貔貅时,头部朝向不可正对大门,因为大门是门神执掌的地方,不可冒犯。可以对着门窗(除正门外)的方向。此外,也不可对着厕所,...

全球资讯:貔貅头方向摆放禁忌 貔貅头方向的摆放介绍 1、摆放貔貅时,头部朝向不可正对大门,因为大门是门神执掌的地方,不可冒犯。可以对着门窗(除正门外)的方向。此外,也不可对着厕所,... -

环球微速讯:家里如何清洗羊肉 家里怎么清洗羊肉 1、把新鲜的羊肉准备好,羊肉一定要买新鲜的,不然不新鲜的羊肉,味道会特别大,大家也别贪这个小便宜。羊肉切成大块,然后放入淘米水中...

环球微速讯:家里如何清洗羊肉 家里怎么清洗羊肉 1、把新鲜的羊肉准备好,羊肉一定要买新鲜的,不然不新鲜的羊肉,味道会特别大,大家也别贪这个小便宜。羊肉切成大块,然后放入淘米水中... -

环球微资讯!现代简约沙发旁边摆件摆什么 现代简约的沙发旁边适合摆什么 1、在沙发旁摆放落地灯,有装饰性,落地灯的材质、样式有一定的装饰空间的效果,精致的款式、造型感较强的款式更是如此,同时灯光氛围也...

环球微资讯!现代简约沙发旁边摆件摆什么 现代简约的沙发旁边适合摆什么 1、在沙发旁摆放落地灯,有装饰性,落地灯的材质、样式有一定的装饰空间的效果,精致的款式、造型感较强的款式更是如此,同时灯光氛围也... -

有奇瑞DP-i智能混动架构做“靠山”,瑞虎7 PLUS新能源到底有多颠覆? 把握时代发展脉搏,以创新科技引领未来,技术理工男奇瑞持续在行动。9月16日,瑶光2025奇瑞科技DAY正式启动,奇瑞品牌不仅携多项黑科技和一

有奇瑞DP-i智能混动架构做“靠山”,瑞虎7 PLUS新能源到底有多颠覆? 把握时代发展脉搏,以创新科技引领未来,技术理工男奇瑞持续在行动。9月16日,瑶光2025奇瑞科技DAY正式启动,奇瑞品牌不仅携多项黑科技和一 -

天天观热点:湖南在建最大跨度钢混组合梁斜桥主塔封顶 9月20日,由中交二航局承建的湖南省在建最大跨度钢混组合梁斜拉桥——官新高速马路口资水特大桥水中6号主塔顺利封顶,标志着大桥全面进...

天天观热点:湖南在建最大跨度钢混组合梁斜桥主塔封顶 9月20日,由中交二航局承建的湖南省在建最大跨度钢混组合梁斜拉桥——官新高速马路口资水特大桥水中6号主塔顺利封顶,标志着大桥全面进... -

全球热议:小米平板 5 国际版推送安卓 12 / MIUI 13.1 更新

IT之家9月21日消息,欧洲和全球国际版的小米平板5已排队等待更新到Android12——这将从少数用户开始,并将逐渐扩大。用户也可以手动进行

全球热议:小米平板 5 国际版推送安卓 12 / MIUI 13.1 更新

IT之家9月21日消息,欧洲和全球国际版的小米平板5已排队等待更新到Android12——这将从少数用户开始,并将逐渐扩大。用户也可以手动进行 -

全球视讯!安徽六安警方发布警情通报:两车高速碰撞起火 一人轻伤 9月21日中午,安徽省六安市公安局交警支队发布警情通报:2022年9月21日7时许,G42沪蓉高速金寨往武汉方向船板冲大桥处,胡某中驾驶载有硅油(

全球视讯!安徽六安警方发布警情通报:两车高速碰撞起火 一人轻伤 9月21日中午,安徽省六安市公安局交警支队发布警情通报:2022年9月21日7时许,G42沪蓉高速金寨往武汉方向船板冲大桥处,胡某中驾驶载有硅油(

热门资讯

-

万古基缘植物复合浓缩液通过市场监管严格检测 近期,万古基缘国际集团天津公司通...

万古基缘植物复合浓缩液通过市场监管严格检测 近期,万古基缘国际集团天津公司通... -

博盛信息咨询,提高金融需求匹配效率 一个行业能存在这么多年,而且行业...

博盛信息咨询,提高金融需求匹配效率 一个行业能存在这么多年,而且行业... -

前员工实名举报!华彬旗下果倍爽使用过期主剂、包材? 华彬的经销商,需要一颗强大的心脏...

前员工实名举报!华彬旗下果倍爽使用过期主剂、包材? 华彬的经销商,需要一颗强大的心脏... -

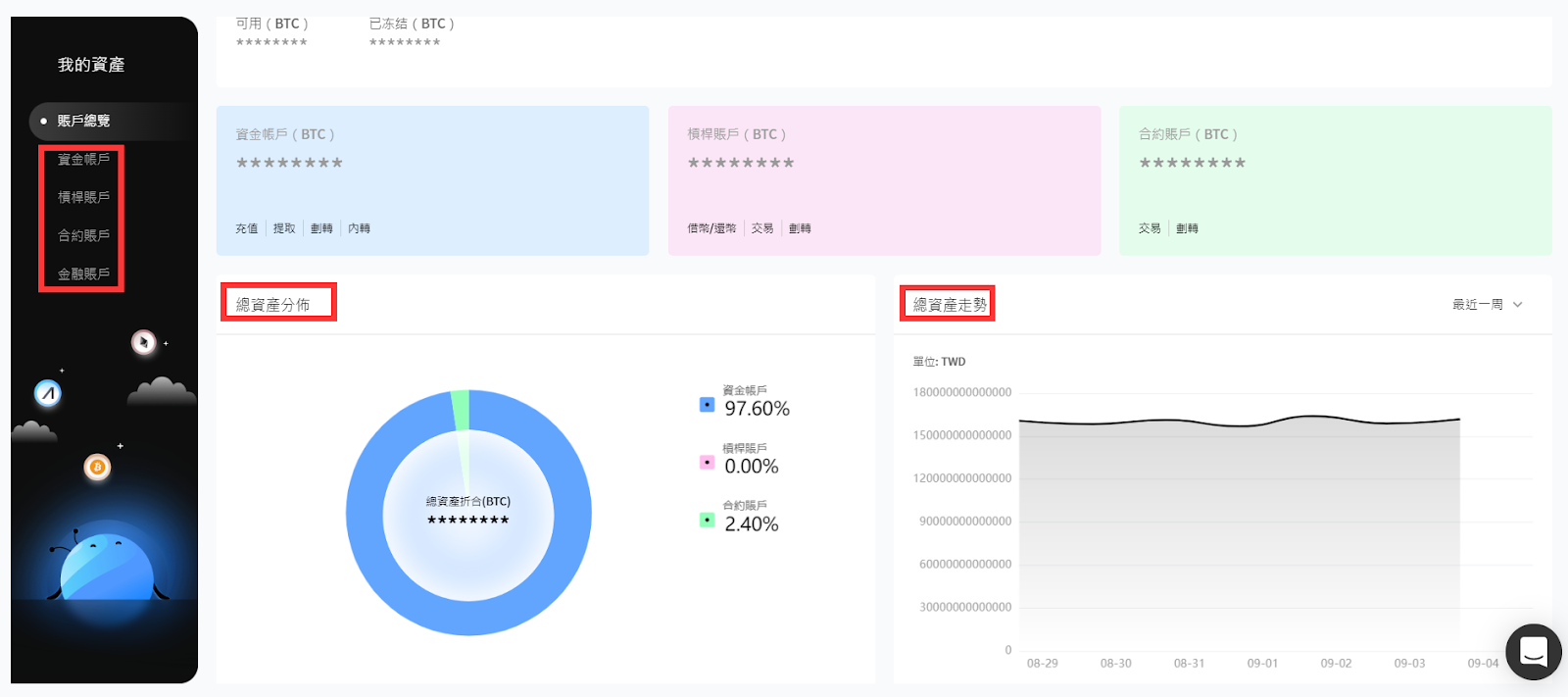

AAX钱包账号全面升级,全新功能全新体验 完善的用户体验和强大的产品实力是...

AAX钱包账号全面升级,全新功能全新体验 完善的用户体验和强大的产品实力是...

观察

图片新闻

-

明确盲盒抽取概率的浮动区间 让消费者明明白白消费 近日,鞍山的盲盒消费者理性了起来...

明确盲盒抽取概率的浮动区间 让消费者明明白白消费 近日,鞍山的盲盒消费者理性了起来... -

赣县区推行工程建设事项一窗办机制后出现的新变化 工程建设项目审批跑腿多、材料多、...

赣县区推行工程建设事项一窗办机制后出现的新变化 工程建设项目审批跑腿多、材料多、... -

银企对接助力文旅行业发展 加速文旅行业复苏 15日,中国人民银行鞍山市中心支行...

银企对接助力文旅行业发展 加速文旅行业复苏 15日,中国人民银行鞍山市中心支行... -

赣县韩坊强化项目监督 为乡村振兴增效赋能 工程进展到哪个阶段了?项目施工是...

赣县韩坊强化项目监督 为乡村振兴增效赋能 工程进展到哪个阶段了?项目施工是...

精彩新闻

-

前沿资讯!屏幕可伸缩,胎死腹中的 LG Rollable 新上手视频流出

IT之家9月21日消息,在LG退出智能...

前沿资讯!屏幕可伸缩,胎死腹中的 LG Rollable 新上手视频流出

IT之家9月21日消息,在LG退出智能... -

环球观天下!智领未来 山西移动“SUPER专网”发布 “‘SUPER专网’不只是移动的专网...

环球观天下!智领未来 山西移动“SUPER专网”发布 “‘SUPER专网’不只是移动的专网... -

全球观点:国家卫健委:我国60岁及以上老年人中约有1500万痴呆患者 日前,在国家卫健委召开的新闻发布...

全球观点:国家卫健委:我国60岁及以上老年人中约有1500万痴呆患者 日前,在国家卫健委召开的新闻发布... -

世界头条:口腔问题不容忽视 “关爱 陪伴 沟通”呵护牙齿健康 9月20日,一年一度的“全国爱牙日...

世界头条:口腔问题不容忽视 “关爱 陪伴 沟通”呵护牙齿健康 9月20日,一年一度的“全国爱牙日... -

世界快消息!大肆非法贩卖网络热门小说,涉案金额780余万元,一被告人被判9年

... IT之家9月21日消息,据“扫黄打非...

世界快消息!大肆非法贩卖网络热门小说,涉案金额780余万元,一被告人被判9年

... IT之家9月21日消息,据“扫黄打非... -

全球视讯!京东方:海信U8H Mini LED电视搭载公司ADS Pro高端LCD显示技术

IT之家9月21日消息,海信昨日发布...

全球视讯!京东方:海信U8H Mini LED电视搭载公司ADS Pro高端LCD显示技术

IT之家9月21日消息,海信昨日发布... -

世界头条:胡萝卜牛奶可以一起吃吗 胡萝卜牛奶适合一起吃吗 1、胡萝卜和牛奶可以一起吃,因为...

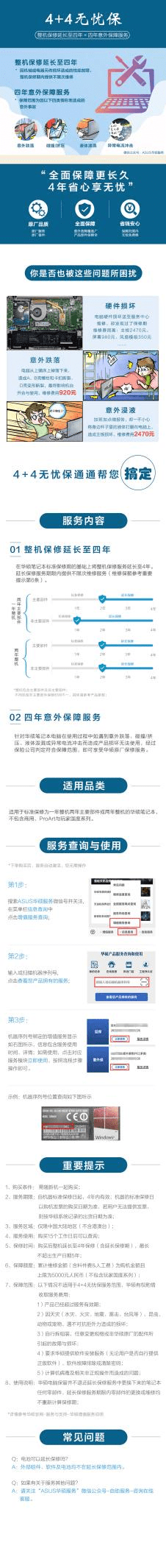

世界头条:胡萝卜牛奶可以一起吃吗 胡萝卜牛奶适合一起吃吗 1、胡萝卜和牛奶可以一起吃,因为... - 华硕中秋节福利来袭,学生专属购机送4+4无忧保 中秋节即将到来,所谓金九银十,华...

-

今日热搜:南华特训学校怎么样 南华特训学校好不好呢 1、长沙的南华特训学校啊,口碑很...

今日热搜:南华特训学校怎么样 南华特训学校好不好呢 1、长沙的南华特训学校啊,口碑很... - 长春农商银行成功发放首笔“科创贷”贷款 年初以来,长春农商银行紧跟省政府...

- 91焕新节学生专属,购机就送价值1299元4+4无忧保 开学季已到,同学们已经大包小包迈...

-

天天热文:孩子读封闭式学校好吗 封闭式学校对孩子真的好吗 1、对于小学高年级到高中这段时间...

天天热文:孩子读封闭式学校好吗 封闭式学校对孩子真的好吗 1、对于小学高年级到高中这段时间... -

世界看点:螃蟹可以和水果一起吃吗 螃蟹可以和水果可以一起吃吗 1、螃蟹不建议和含有鞣酸较多的水...

世界看点:螃蟹可以和水果一起吃吗 螃蟹可以和水果可以一起吃吗 1、螃蟹不建议和含有鞣酸较多的水... -

天天速递!牛奶与蟹能一起吃吗 牛奶与蟹能不能一起吃 1、牛奶和螃蟹一般可以一起吃,不...

天天速递!牛奶与蟹能一起吃吗 牛奶与蟹能不能一起吃 1、牛奶和螃蟹一般可以一起吃,不... -

环球速看:《命运 2》开发商 Bungie 遭外挂开发商起诉

IT之家9月21日消息,《命运2》的开...

环球速看:《命运 2》开发商 Bungie 遭外挂开发商起诉

IT之家9月21日消息,《命运2》的开... -

世界时讯:平安人寿内蒙古分公司推出平安臻享RUN健康服务计划 平安人寿内蒙古分公司健康节特色服...

世界时讯:平安人寿内蒙古分公司推出平安臻享RUN健康服务计划 平安人寿内蒙古分公司健康节特色服... -

环球快看点丨设计时速 350 公里,合杭高铁湖杭段明日开通运营

IT之家9月21日消息,据“长三角铁...

环球快看点丨设计时速 350 公里,合杭高铁湖杭段明日开通运营

IT之家9月21日消息,据“长三角铁... -

天天通讯!小米 Civi 2 参数再曝光:重 171.8 克,厚 7.23mm

IT之家9月21日消息,小米Civi2新品...

天天通讯!小米 Civi 2 参数再曝光:重 171.8 克,厚 7.23mm

IT之家9月21日消息,小米Civi2新品... -

720p是什么意思 手机录的视频能720p分辨率吗? 720p是什么意思?720p指屏幕分辨率...

720p是什么意思 手机录的视频能720p分辨率吗? 720p是什么意思?720p指屏幕分辨率... -

2025年底实现主城区试点社区全覆盖!怀化市印发方案 近日,我市城市一刻钟便民生活圈建...

2025年底实现主城区试点社区全覆盖!怀化市印发方案 近日,我市城市一刻钟便民生活圈建... -

环球信息:吉林安图:“黄金花”铺就乡村振兴幸福路 吉林省延边州安图县新合乡千济方长...

环球信息:吉林安图:“黄金花”铺就乡村振兴幸福路 吉林省延边州安图县新合乡千济方长... -

环球短讯!国家能源局:1-8 月全国太阳能发电装机容量约 3.5 亿千瓦

IT之家9月21日消息,今日,国家能...

环球短讯!国家能源局:1-8 月全国太阳能发电装机容量约 3.5 亿千瓦

IT之家9月21日消息,今日,国家能... -

皇冠假日酒店创新不止 推出沉浸式元宇宙文旅体验 旅行不设限 商务亦休闲2022年9月2...

皇冠假日酒店创新不止 推出沉浸式元宇宙文旅体验 旅行不设限 商务亦休闲2022年9月2... -

天天热资讯!泉州惠安:校服产业智能化 生产基地项目进展顺利 日前,在泉州市惠安县中国校园服饰...

天天热资讯!泉州惠安:校服产业智能化 生产基地项目进展顺利 日前,在泉州市惠安县中国校园服饰... -

每日快看:发挥重大项目牵引作用 上海持续促投资稳经济 20日举行的“潮涌浦江”投资上海全...

每日快看:发挥重大项目牵引作用 上海持续促投资稳经济 20日举行的“潮涌浦江”投资上海全... -

世界速递!2022年9月21日24时起国内成品油价格按机制下调 根据近期国际市场油价变化情况,按...

世界速递!2022年9月21日24时起国内成品油价格按机制下调 根据近期国际市场油价变化情况,按... -

观热点:抬头望歌词 抬头望的歌词和歌手 1、(抬头望)的歌词:人人要个忠...

观热点:抬头望歌词 抬头望的歌词和歌手 1、(抬头望)的歌词:人人要个忠... -

【环球速看料】一加 Nord Watch 智能手表预热,采用 1.78 英寸 AMOLED 屏幕

IT之家9月21日消息,早在今年3月22...

【环球速看料】一加 Nord Watch 智能手表预热,采用 1.78 英寸 AMOLED 屏幕

IT之家9月21日消息,早在今年3月22... -

资讯推荐:车里添置的小物件是什么 适合添置在车里的小物件 1、手电筒,目前虽然汽车救援、维...

资讯推荐:车里添置的小物件是什么 适合添置在车里的小物件 1、手电筒,目前虽然汽车救援、维... -

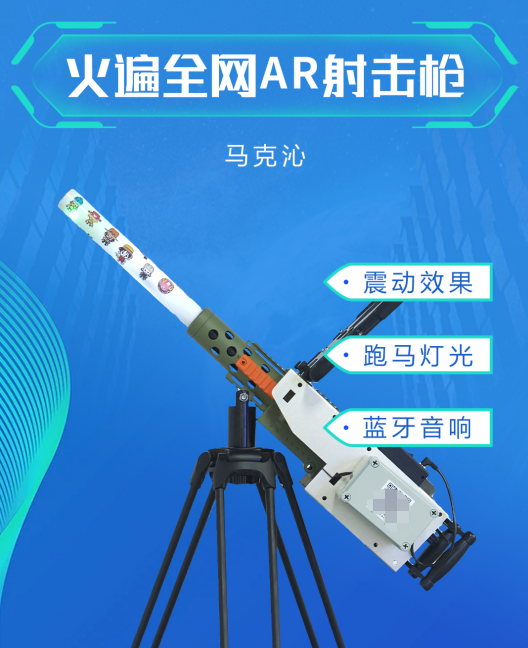

广州酷棋网络科技有限公司:推动AR游乐设普及应用! - 财经 - 海报青年网 早些年的AR游戏枪虽然已经开始出现...

广州酷棋网络科技有限公司:推动AR游乐设普及应用! - 财经 - 海报青年网 早些年的AR游戏枪虽然已经开始出现... -

好品客长沙开业,零售的又一匹黑马出世 长沙梅溪湖枫林三路,一家新零售折...

好品客长沙开业,零售的又一匹黑马出世 长沙梅溪湖枫林三路,一家新零售折... -

世界实时:未开封淡奶油保存方法 未开封淡奶油如何保存 1、未开封的淡奶油可以常温保存,...

世界实时:未开封淡奶油保存方法 未开封淡奶油如何保存 1、未开封的淡奶油可以常温保存,... -

华硕免费送价值1299元的4+4无忧保服务啦!这么激活特简单! 金九银十,秋意渐浓,科技数码界的...

华硕免费送价值1299元的4+4无忧保服务啦!这么激活特简单! 金九银十,秋意渐浓,科技数码界的... -

全球看点:没有开封红酒保存方法 没有开封红酒如何保存 1、静置在无异味、通风、避光的环...

全球看点:没有开封红酒保存方法 没有开封红酒如何保存 1、静置在无异味、通风、避光的环... -

环球今日讯!14岁男孩不想上学怎么办 14岁男孩不想上学怎么教育 1、14岁的小孩儿不愿意上学,建议...

环球今日讯!14岁男孩不想上学怎么办 14岁男孩不想上学怎么教育 1、14岁的小孩儿不愿意上学,建议... -

襄阳再曝重磅大手笔!42万方车城湖公园效果图惊艳曝光! 近日,襄阳连山湖片区利好频传,42...

襄阳再曝重磅大手笔!42万方车城湖公园效果图惊艳曝光! 近日,襄阳连山湖片区利好频传,42... -

菜鸟开通“世界杯”物流专线 义乌足球、喇叭、球服20天直达卡塔尔 距2022年第二十二届世界杯还有2个...

菜鸟开通“世界杯”物流专线 义乌足球、喇叭、球服20天直达卡塔尔 距2022年第二十二届世界杯还有2个... -

天天热推荐:亦庄产业园租金逆势增长,“专精特新”引领未来发展机遇 今年,正值北京经济技术开发区建设...

天天热推荐:亦庄产业园租金逆势增长,“专精特新”引领未来发展机遇 今年,正值北京经济技术开发区建设... -

快看:城投强势拿地背后 马上迎来2022四季度,当下土地市场...

快看:城投强势拿地背后 马上迎来2022四季度,当下土地市场... -

热门看点:火狐Firefox浏览器105正式版发布

IT之家9月21日消息,几周前,谷歌C...

热门看点:火狐Firefox浏览器105正式版发布

IT之家9月21日消息,几周前,谷歌C... -

全球今亮点!农业生产一线见闻:坐在办公室里种田 国庆将至,秋色渐浓。地处三江平原...

全球今亮点!农业生产一线见闻:坐在办公室里种田 国庆将至,秋色渐浓。地处三江平原... -

环球精选!四川泸定地震失联17天的甘宇已经找到 生命体征平稳 四川泸定6 8级地震中失联17天的甘...

环球精选!四川泸定地震失联17天的甘宇已经找到 生命体征平稳 四川泸定6 8级地震中失联17天的甘... -

世界简讯:响水县财政局开展政府采购法颁布20周年知识竞赛活动 为营造良好的尊法、学法、守法、用...

世界简讯:响水县财政局开展政府采购法颁布20周年知识竞赛活动 为营造良好的尊法、学法、守法、用... -

【天天聚看点】又一个全球“四大所”来了!毕马威签约落户无锡高新区 9月20日,无锡高新区——毕马威战...

【天天聚看点】又一个全球“四大所”来了!毕马威签约落户无锡高新区 9月20日,无锡高新区——毕马威战... -

天天信息:《使命召唤19:现代战争2》公开试玩页面上线Steam,9月25日开启

IT之家9月21日消息,《使命召唤19...

天天信息:《使命召唤19:现代战争2》公开试玩页面上线Steam,9月25日开启

IT之家9月21日消息,《使命召唤19... -

热头条丨Q2印度个人电脑和平板电脑市场出货460万台,惠普/联想/戴尔前三

IT之家9月21日消息,Canalys最新报...

热头条丨Q2印度个人电脑和平板电脑市场出货460万台,惠普/联想/戴尔前三

IT之家9月21日消息,Canalys最新报... -

全球热推荐:广州“十四五”阶段目标累计建成制氢站3座以上、加氢站50座以上

... IT之家9月21日消息,今日,广州市...

全球热推荐:广州“十四五”阶段目标累计建成制氢站3座以上、加氢站50座以上

... IT之家9月21日消息,今日,广州市... -

挥杆筑梦 益起美好丨第十二届“瑞尔杯”慈善高尔夫球赛圆满落幕 2022年9月20日正值第34个全国爱牙...

挥杆筑梦 益起美好丨第十二届“瑞尔杯”慈善高尔夫球赛圆满落幕 2022年9月20日正值第34个全国爱牙... -

世界信息:车企为何扎堆泰国? 9月16日,哪吒汽车与泰国最大的石...

世界信息:车企为何扎堆泰国? 9月16日,哪吒汽车与泰国最大的石... -

世界热文:软盘仍未“彻底灭绝”,航空公司仍是大客户

IT之家9月21日消息,作为上世纪80-...

世界热文:软盘仍未“彻底灭绝”,航空公司仍是大客户

IT之家9月21日消息,作为上世纪80-...